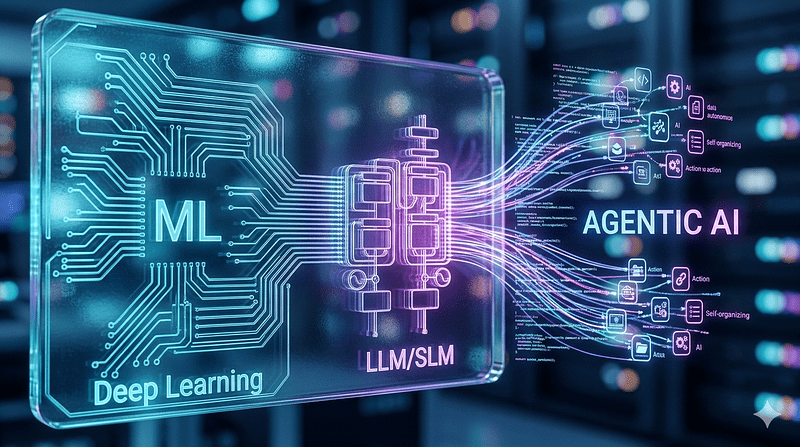

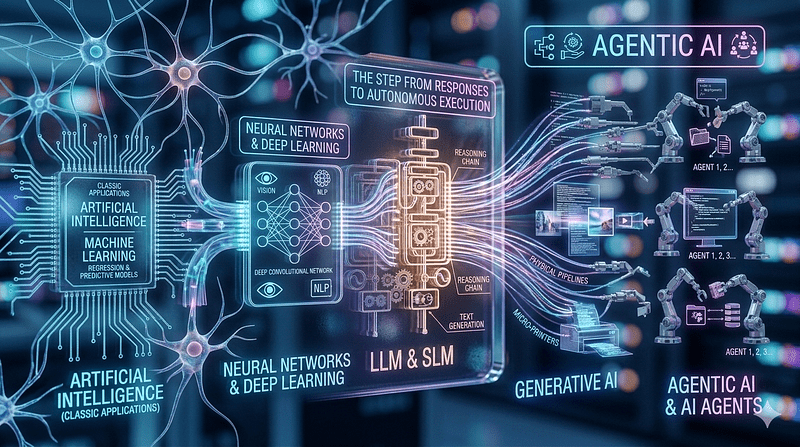

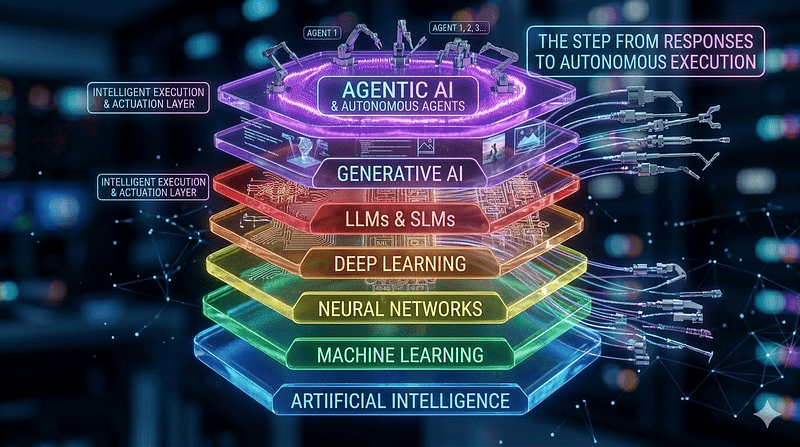

El AI Stack desde Machine Learning hasta Agentic AI explica cómo se organiza realmente la inteligencia artificial moderna. Más que una sola tecnología, la IA es un ecosistema de capas interconectadas donde cada nivel, desde el aprendizaje automático hasta los agentes autónomos; construye capacidades cada vez más complejas.

La inteligencia artificial ha dejado de ser interpretada como una herramienta aislada para consolidarse como un ecosistema dinámico de capas interconectadas, donde cada nivel sustenta la innovación del siguiente.

En el 2026, la comprensión de esta estructura no es solo un requisito técnico, sino una necesidad estratégica para el liderazgo tecnológico, permitiendo identificar cómo las piezas de este rompecabezas (desde el hardware fundacional hasta la autonomía agéntica), encajan para transformar la productividad global. La transición de sistemas que simplemente asisten a sistemas que ejecutan flujos de trabajo de forma independiente, marca el inicio de una nueva era industrial impulsada por la inteligencia conectada.

Cómo funcionan realmente las capas que están construyendo el futuro de la inteligencia

La inteligencia artificial suele presentarse como un concepto único, casi mágico. Pero la realidad es mucho más interesante: la IA es un ecosistema de capas tecnológicas, construido durante décadas de investigación, donde cada nivel se apoya sobre el anterior.

Entender este AI Stack no solo ayuda a evitar confusiones entre términos como Machine Learning, Deep Learning o Generative AI, sino que también permite diseñar mejores sistemas, elegir tecnologías adecuadas y anticipar hacia dónde se dirige la industria. Para entender el AI Stack desde Machine Learning hasta Agentic AI, es necesario observar cómo cada capa evoluciona sobre la anterior.

Artificial Intelligence (AI)

La IA es el campo general que busca crear sistemas capaces de realizar tareas que normalmente requieren inteligencia humana: razonamiento, aprendizaje, percepción o toma de decisiones. Ejemplos clásicos:

- Chatbots.

- Sistemas de recomendación.

- Robots industriales.

- Sistemas de diagnóstico médico.

La IA moderna combina múltiples enfoques: lógica simbólica, aprendizaje automático, modelos probabilísticos y redes neuronales. Históricamente, los primeros sistemas de IA eran rule-based systems:

def loan_approval(income, credit_score):

if income > 50000 and credit_score > 700:

return "Approved"

else:

return "Denied"Lenguaje del código: PHP (php)Este tipo de sistema no aprende, sólo ejecuta reglas definidas por humanos; por eso surgió la siguiente capa.

Machine Learning (ML)

Es un subconjunto de la IA donde los sistemas aprenden patrones a partir de datos, sin ser programados explícitamente para cada caso. En lugar de definir reglas, entrenamos modelos. Ejemplo: clasificación con Scikit-Learn.

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

# dataset

X, y = load_iris(return_X_y=True)

# dividir datos

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2)

# modelo

model = RandomForestClassifier()

# entrenamiento

model.fit(X_train, y_train)

# predicción

predictions = model.predict(X_test)

print(predictions[:5])Lenguaje del código: PHP (php)- Casos de uso comunes: predicción de fraude, recomendación de productos, predicción de demanda o análisis de churn. Pero el ML tradicional tiene límites cuando los datos son muy complejos o de alta dimensión; ahí entran las redes neuronales.

Neural Networks (NN)

Se inspiran en la estructura del cerebro humano: nodos interconectados que procesan información. Cada neurona artificial calcula:

output = activation(weight * input + bias)Las redes modernas se entrenan mediante backpropagation, un algoritmo que ajusta los pesos para minimizar el error. Ejemplo en PyTorch:

import torch

import torch.nn as nn

# red neuronal simple

class NeuralNetwork(nn.Module):

def __init__(self):

super().__init__()

self.layer1 = nn.Linear(4, 8)

self.layer2 = nn.Linear(8, 3)

def forward(self, x):

x = torch.relu(self.layer1(x))

x = self.layer2(x)

return x

model = NeuralNetwork()

sample = torch.rand((1,4))

output = model(sample)

print(output)- Aplicaciones típicas: reconocimiento de imágenes, procesamiento del lenguaje, detección de anomalías o predicción financiera. Pero cuando estas redes crecen en profundidad… ocurre algo poderoso.

Deep Learning (DL)

Es una evolución de las redes neuronales: más capas, más datos, más poder computacional. Esto permitió avances históricos en: visión por computadora, reconocimiento de voz, NLP y conducción autónoma. Los modelos modernos incluyen arquitecturas como: CNN, RNN, Transformers, Autoencoders, entre otras.

- Ejemplo simple de red profunda en TensorFlow

from tensorflow import keras

from tensorflow.keras import layers

model = keras.Sequential([

layers.Dense(128, activation="relu"),

layers.Dense(64, activation="relu"),

layers.Dense(10, activation="softmax")

])

model.compile(

optimizer="adam",

loss="sparse_categorical_crossentropy",

metrics=["accuracy"]

)

print(model.summary())Lenguaje del código: JavaScript (javascript)El deep learning permitió entrenar modelos generativos, capaces de crear contenido nuevo.

Generative AI

Es una rama de la IA capaz de generar contenido nuevo: texto, imágenes, audio, código o video. Entre los modelos generativos encontramos: GANs, VAEs, Diffusion models, LLMs. Un ejemplo clásico es GAN (Generative Adversarial Networks), donde dos redes compiten: generador y discriminador, esto permite crear datos sintéticos realistas.

- Ejemplo conceptual en PyTorch

import torch

import torch.nn as nn

class Generator(nn.Module):

def __init__(self):

super().__init__()

self.net = nn.Sequential(

nn.Linear(100, 256),

nn.ReLU(),

nn.Linear(256, 784),

nn.Tanh()

)

def forward(self, x):

return self.net(x)

generator = Generator()

noise = torch.randn(1,100)

fake_image = generator(noise)

print(fake_image.shape)Hoy vemos generative AI en: ChatGPT, Midjourney, Copilot, Claude, Gemini y otros. Pero dentro de este mundo hay dos categorías clave.

Large Language Models (LLMs) y Small Language Models (SLMs)

- LLMs: son modelos gigantes con miles de millones de parámetros. Sus ventajas: el razonamiento complejo, la generación extensa y la comprensión contextual profunda. Su arquitectura base: Transformers. Ejemplo usando HuggingFace:

from transformers import pipeline

generator = pipeline("text-generation", model="gpt2")

text = generator(

"Artificial Intelligence will transform",

max_length=40

)

print(text)Lenguaje del código: JavaScript (javascript)- SLMs: son versiones más compactas optimizadas para: menor latencia, menor consumo energético y ejecución local. Se usan en: dispositivos edge, automatización empresarial y asistentes embebidos. La tendencia actual en sistemas productivos es arquitecturas híbridas:

SLM -> tareas rápidas

LLM -> razonamiento complejo

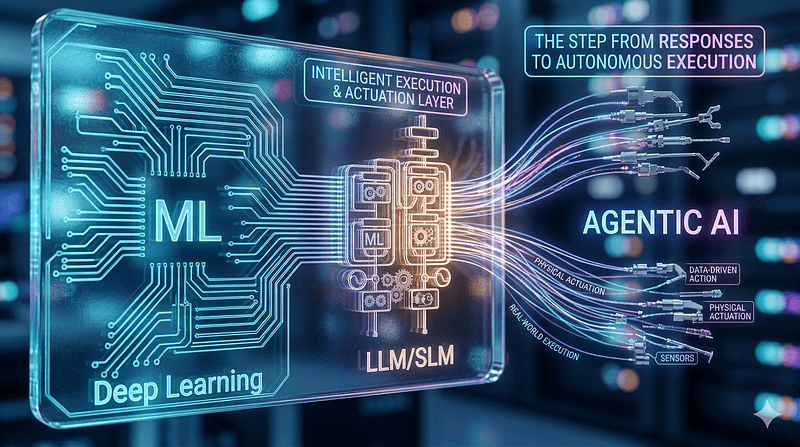

AI Agents y Agentic AI

La capa más reciente es Agentic AI. Aquí la IA deja de ser solo un generador de respuestas y se convierte en un sistema que planifica y ejecuta acciones. Un agente puede: planificar tareas, usar herramientas, recordar información o tomar decisiones. Estos sistemas se consideran intelligent agents, capaces de actuar de forma autónoma en entornos complejos.

- Arquitectura típica de un agente:

User ↓ LLM reasoning ↓ Planning ↓ Tools / APIs ↓ Execution ↓ Memory

- Ejemplo de agente en Python:

import requests

from google.colab import userdata

def search_weather(city):

api_key = userdata.get('WEATHER_API_KEY') # Retrieve the API key from Colab secrets

url = f"https://api.weatherapi.com/v1/current.json?key={api_key}&q={city}"

response = requests.get(url)

response.raise_for_status() # Raise an HTTPError for bad responses (4xx or 5xx)

return response.json()

def agent(city):

data = search_weather(city)

# Check if 'current' key exists before accessing it

if 'current' in data and 'temp_c' in data['current']:

temp = data["current"]["temp_c"]

else:

# Handle cases where 'current' or 'temp_c' might be missing even in a 'successful' JSON response

print(f"Could not retrieve temperature for {city}. API response: {data}")

return "No pude obtener la temperatura actual."

if temp < 15:

return "Hace frío, lleva chaqueta."

else:

return "El clima está agradable."

print(agent("Bogota"))Lenguaje del código: PHP (php)Frameworks populares: LangChain, CrewAI, AutoGPT, Semantic Kernel, etc.

¿Cómo se combinan todas estas capas en sistemas reales?

Un sistema moderno de AI Stack desde Machine Learning hasta Agentic AI puede verse así:

AI Agents

↑

Generative AI

↑

LLMs / SLMs

↑

Deep Learning

↑

Neural Networks

↑

Machine Learning

↑

Artificial Intelligence

Ejemplo real de arquitectura: un asistente de atención al cliente podría usar:

- CNN → analizar imágenes de productos

- LLM → responder preguntas

- RAG → recuperar información de documentos

- Agent → ejecutar procesos de soporte

La inteligencia emerge de la combinación de capas.

El futuro del AI Stack

La próxima evolución apunta a tres tendencias claras:

- AI multi-agent systems: múltiples agentes colaborando.

- Modelos híbridos: SLMs + LLMs + herramientas.

- Autonomía progresiva: IA que ejecuta procesos completos.

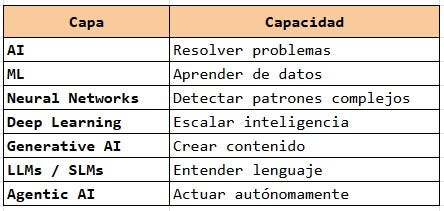

Incluso se está explorando la idea de un Agentic Web, donde redes de agentes colaboran en internet como una nueva capa de inteligencia distribuida. La IA no es una sola tecnología, es una arquitectura evolutiva de capas que durante décadas ha ido agregando capacidades:

El ecosistema de la inteligencia artificial en 2026 es un testimonio de la convergencia entre la potencia del software y la solidez de la infraestructura física. En el AI Stack desde Machine Learning hasta Agentic AI, desde el ML que sustenta la analítica predictiva hasta los agentes autónomos que ejecutan la estrategia empresarial, cada capa del stack tecnológico ofrece una oportunidad única para la innovación y la eficiencia. Sin embargo, la verdadera ventaja competitiva reside en la capacidad de integrar estas capas bajo un marco de confianza, seguridad y ética.

El futuro de la IA no pertenece a quienes adoptan la tecnología más rápido, sino a quienes la integran mejor en sus cimientos operativos, entendiendo que cada vatio de energía, cada token de razonamiento y cada acción agéntica deben estar alineados con un propósito humano superior. En este nuevo orden económico, la inteligencia ya no es un atributo individual de las máquinas, sino una propiedad conectada de un ecosistema global que está redefiniendo los límites de lo posible. La gran transición que estamos viviendo es clara, de herramientas inteligentes → a sistemas autónomos. Y quien entienda este stack no solo usará la IA… la diseñará.