La seguridad de los sistemas de inteligencia artificial ha evolucionado desde la protección de modelos estáticos hacia la salvaguarda de agentes autónomos. Estos sistemas no solo generan texto, sino que razonan, planifican y ejecutan acciones mediante herramientas, lo que introduce una superficie de ataque dinámica y compleja. Al igual que en la infraestructura tradicional, los riesgos en la IA agéntica requieren un enfoque robusto que abarque desde el diseño inicial hasta el monitoreo continuo de las aplicaciones que hagan uso de agentes.

OWASP Top 10 para aplicaciones agénticas 2026

A continuación, analizamos las 10 vulnerabilidades críticas del OWASP Top 10 para aplicaciones agénticas para 2026 [1-2]:

- ASI01: Secuestro de objetivos (Goal Hijack): Este riesgo consiste en la redirección maliciosa de las metas originales del agente a través de una cadena de razonamiento manipulada. Un atacante puede introducir instrucciones sutiles que, tras varios pasos de planificación, desvíen al agente de su propósito legítimo hacia acciones que beneficien al atacante, comprometiendo la integridad del sistema.

- ASI02: Uso Indebido de herramientas: Los agentes utilizan herramientas (APIs, bases de datos, calculadoras) para interactuar con el mundo. Esta vulnerabilidad surge de una composición insegura de estas herramientas, donde un agente puede ser inducido a orquestarlas de forma que causen daños, como el borrado masivo de datos o la ejecución de llamadas a API con parámetros maliciosos.

- ASI03: Abuso de identidad: Se refiere a la explotación de la autoridad delegada al agente. Si un agente tiene permisos excesivos para actuar en nombre de un usuario, violando el principio de mínimo privilegio, un compromiso del agente permitiría al atacante realizar acciones con la identidad y confianza del usuario original.

- ASI04: Cadena de suministro de agentes: Al igual que el software tradicional sufre por componentes obsoletos, los sistemas agénticos enfrentan riesgos en su cadena de suministro dinámica. Esto incluye el uso de modelos, plugins o herramientas de terceros que pueden estar comprometidos o contener vulnerabilidades en su tiempo de ejecución (runtime).

- ASI05: Ejecución de código: Muchos agentes tienen la capacidad de generar y ejecutar código en tiempo real para resolver problemas complejos. Si no existe una segmentación adecuada o un entorno de ejecución seguro (sandbox), el agente podría generar código malicioso que comprometa el servidor subyacente.

- ASI06: Envenenamiento de memoria: Los agentes utilizan memoria persistente y contexto para aprender de interacciones pasadas. Un ataque de envenenamiento introduce información falsa o maliciosa en esta memoria, lo que provoca que el agente tome decisiones sesgadas o peligrosas en el futuro de forma persistente.

- ASI07: Comunicación entre agentes: En arquitecturas multi-agente, la suplantación y manipulación de mensajes entre agentes es un riesgo crítico. La falta de métodos de autenticación fuertes entre componentes permite que un agente malicioso intercepte o altere las comunicaciones, rompiendo la confianza del ecosistema.

- ASI08: Fallos en cascada: Dada la interconexión de los agentes, un error o una entrada maliciosa en un agente inicial puede propagarse y amplificarse a través de toda la cadena. Esto puede llevar a una denegación de servicio o a una ejecución masiva de acciones erróneas antes de que los sistemas de detección de amenazas puedan reaccionar.

- ASI09: Explotación de la confianza: Este riesgo implica el uso indebido de la automatización por parte del sistema. Si los usuarios confían ciegamente en la autoridad del agente sin realizar revisiones humanas o auditorías de las decisiones tomadas, se abre la puerta a que fallos de lógica o manipulaciones externas escalen rápidamente.

- ASI10: Agentes maliciosos: Se refiere a la desviación de la conducta del agente respecto a sus principios éticos o directrices de seguridad. Un agente puede volverse «malicioso» debido a una desalineación en su entrenamiento o a una configuración insegura por defecto, realizando acciones que violan las políticas de la organización

Auditorías de seguridad en aplicaciones agénticas

Las auditorías de seguridad en aplicaciones agénticas representan una evolución crítica respecto a las auditorías de infraestructura tradicional. Mientras que una auditoría clásica se centra en servidores y redes, en el mundo de la IA agéntica el foco se desplaza hacia la autonomía, el razonamiento y la ejecución de acciones mediante herramientas. Siguiendo la metodología de evaluación sistemática para identificar vulnerabilidades antes de que sean explotadas, una auditoría de agentes debe cubrir los siguientes componentes:

1. Auditoría de planificación y razonamiento (control de ASI01)

El objetivo es verificar que el agente no pueda ser desviado de sus metas originales mediante técnicas de secuestro de objetivos (Goal Hijack).

- Pruebas de inyección de instrucciones: Evaluar si entradas maliciosas en lenguaje natural pueden redefinir las prioridades del agente.

- Análisis de desviación conductual: Verificar si el agente mantiene su alineación bajo escenarios de estrés o instrucciones contradictorias.

2. Auditoría de orquestación de herramientas (control de ASI02 y ASI05)

A diferencia del escaneo de vulnerabilidades tradicional que busca software obsoleto, aquí el objetivo es auditar la composición dinámica de herramientas.

- Simulación de uso indebido: Evaluar si el agente puede ser inducido a ejecutar combinaciones de herramientas peligrosas (ej. borrar un backup antes de cerrar una base de datos).

- Revisión de sandboxing: Comprobar que la generación y ejecución de código por parte del agente ocurra en entornos aislados para evitar compromisos del sistema operativo subyacente.

3. Auditoría de identidad y autoridad delegada (control de ASI03 y ASI09)

Equivalente a la auditoría de gestión de identidades e IAM en infraestructura.

- Verificación del mínimo privilegio: Comprobar que los tokens y credenciales delegados al agente sólo permiten las acciones estrictamente necesarias para su función.

- Análisis de abuso de confianza: Evaluar qué tan fácil es para un atacante realizar acciones con la autoridad del usuario a través del agente.

4. Auditoría de memoria y contexto (control de ASI06)

Los agentes utilizan memoria persistente para aprender de interacciones pasadas.

- Detección de envenenamiento de memoria: Evaluar la capacidad del sistema para identificar información falsa o maliciosa inyectada en el historial del agente que podría corromper decisiones futuras.

5. Análisis de arquitectura y fallos en cascada (control de ASI07 y ASI08)

Similar al análisis de arquitectura a nivel de red y segmentación.

- Seguridad en comunicación inter-Agente: Revisar si existen métodos de autenticación y cifrado en las comunicaciones entre distintos agentes para evitar la suplantación.

- Simulación de propagación de errores: Evaluar cómo un fallo en un agente afecta al resto del ecosistema para prevenir caídas sistémicas.

Mejores prácticas de seguridad en aplicaciones agénticas

Para mitigar los riesgos analizados, es fundamental aplicar principios de confianza cero (Zero Trust) y realizar auditorías que incluyan:

- Escaneo de vulnerabilidades y pentesting: Simular ataques de secuestro de objetivos para evaluar la resiliencia del agente.

- Gestión de identidades (IAM): Limitar estrictamente los permisos de los agentes siguiendo el principio de mínimo privilegio.

- Monitoreo y logging: Registrar cada paso del razonamiento y cada uso de herramienta para detectar anomalías de manera oportuna.

- Seguridad en el diseño: Implementar entornos aislados para la ejecución de código y mecanismos de validación humana para acciones de alto impacto.

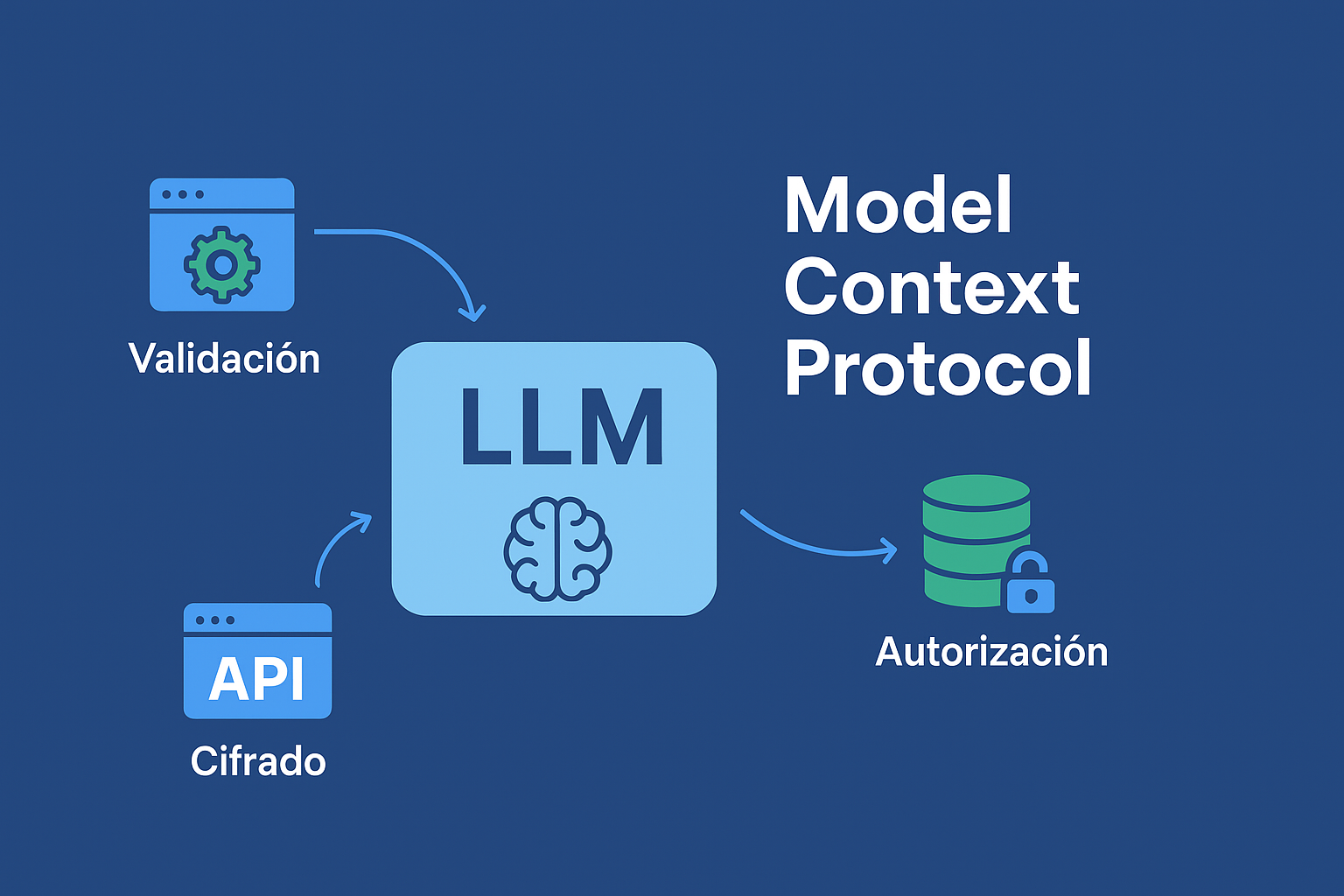

El modelo Zero Trust parte de la premisa «nunca confiar, siempre verificar», lo que resulta especialmente crítico en sistemas agénticos donde el agente toma decisiones autónomas encadenadas y puede interactuar con múltiples herramientas, APIs y fuentes de datos externas.

- Verificación continua de identidad. Cada llamada que el agente realiza a una herramienta, API o sistema externo debe autenticarse de forma independiente, independientemente de que la solicitud venga de un agente considerado «de confianza». No se asume ninguna sesión persistente segura.

- Microsegmentación de accesos. El agente no debe tener acceso a un entorno plano. Sus permisos se segmentan por herramienta, por tipo de acción (lectura, escritura, ejecución) y por contexto de la tarea en curso. Si el agente está procesando una consulta de usuario, no necesita acceso a la base de datos de configuración del sistema.

- Acceso justo a tiempo (JIT). En lugar de otorgar permisos permanentes, se emiten tokens o credenciales de corta duración que expiran una vez completada la acción. Esto limita la ventana de exposición en caso de compromiso.

- Validación del contexto de solicitud. Cada acción del agente se valida no solo por identidad sino también por contexto: ¿es coherente esta acción con la tarea asignada?, ¿se ha solicitado desde un flujo normal o es una desviación inesperada?, ¿el volumen de peticiones es razonable?

Referencias

[1] https://genai.owasp.org/resource/owasp-top-10-for-agentic-applications-for-2026

[2] https://github.com/precize/Agentic-AI-Top10-Vulnerability