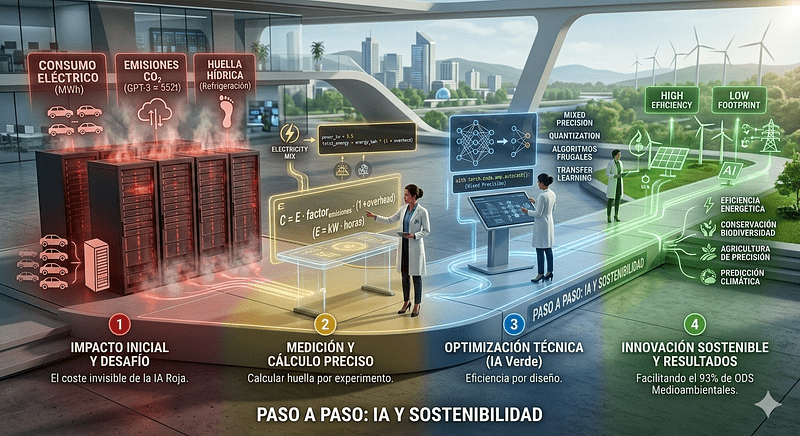

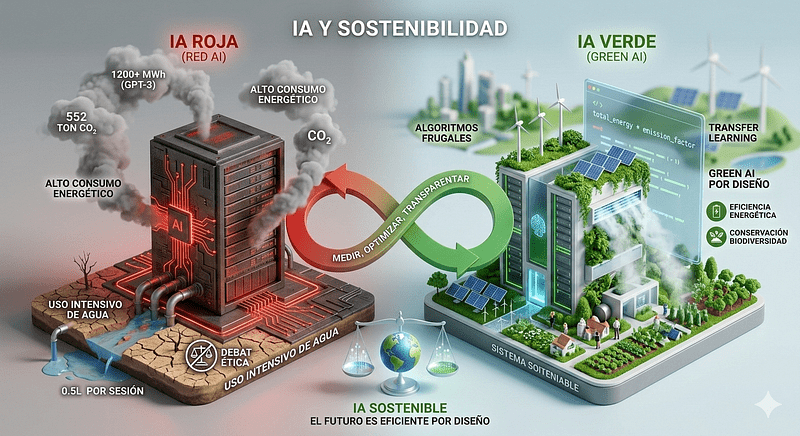

El impacto de la Inteligencia Artificial (IA) en el medio ambiente es multifacético y contradictorio, presentándose tanto como una herramienta con gran potencial para la sostenibilidad como un consumidor masivo de recursos naturales. Es un tema crucial en el debate sobre sostenibilidad tecnológica. Aunque la IA ofrece soluciones innovadoras, también genera un consumo energético elevado, emisiones de CO₂ y demanda de agua para refrigeración.

El auge de modelos de lenguaje y visión a gran escala ha traído avances enormes, pero también un coste ambiental real: consumo energético elevado, emisiones de CO₂ y demanda de recursos hídricos y de refrigeración. Abordar esto exige medir, comparar y optimizar desde la investigación hasta la producción.

¿Cuánto pesa realmente la “nube”?

¿Alguna vez te has preguntado cuánto carbono cuesta un “Hola” de ChatGPT? Mientras el mundo se maravilla con la capacidad de la Inteligencia Artificial para redactar correos o generar imágenes hiperrealistas, una sombra invisible crece en los centros de datos. No podemos hablar de innovación sin hablar de factura energética.

- Inferencia diaria: el uso cotidiano también suma; una sola consulta a un sistema como ChatGPT utiliza hasta diez veces más energía que una búsqueda web tradicional. Se estima que los centros de datos ya consumen el 2% de la electricidad mundial y podrían duplicar este consumo para 2030.

El costo invisible

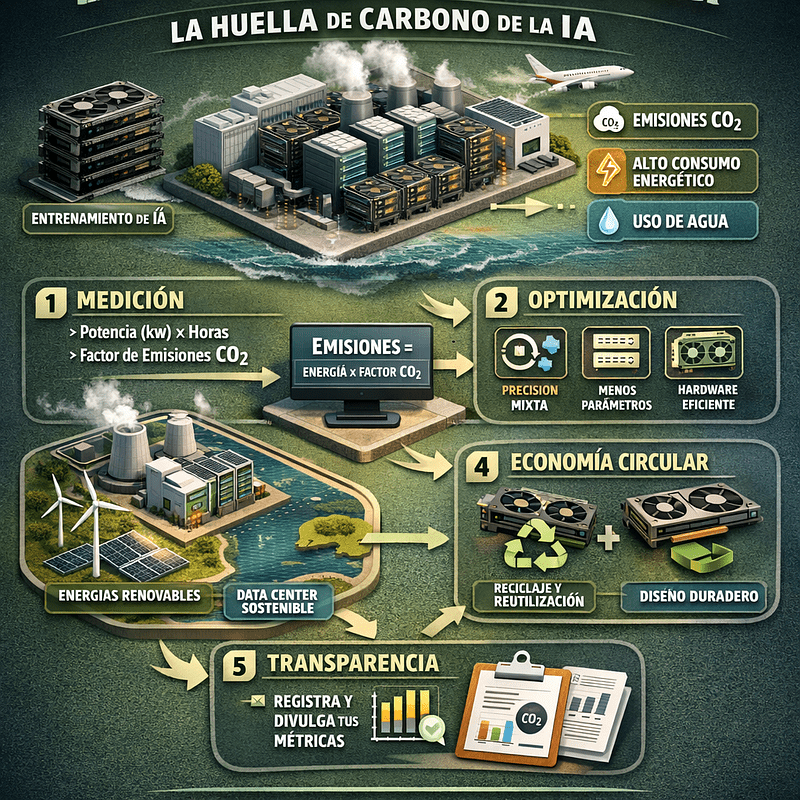

Entrenar un modelo de lenguaje de gran tamaño (LLM) no es solo un proceso matemático; es un proceso térmico pues, requieren una potencia computacional masiva que se traduce en un gasto eléctrico asombroso.

- La huella de carbono: entrenar un modelo de IA de última generación puede emitir tanto CO2 como cinco coches (incluida la fabricación). Por ejemplo, el entrenamiento de GPT-3 consumió más de 1,200 MWh, generando aproximadamente 552 toneladas de CO₂, lo que equivale a las emisiones de un coche durante toda su vida útil o a cientos de vuelos transcontinentales.

- Consumo eléctrico: el sector tecnológico ya consume aproximadamente el 2–3% de la electricidad mundial, y con la fiebre de la IA generativa, esta cifra va camino a dispararse.

- Hardware y residuos: la fabricación de chips avanzados depende de minerales críticos (tierras raras, cobalto) cuya extracción es ambientalmente dañina. Además, el rápido ritmo de innovación provoca una obsolescencia acelerada del hardware, proyectando la generación de entre 1.2 y 5 millones de toneladas de residuos electrónicos para la próxima década.

El dilema del agua

El impacto ambiental de la inteligencia artificial se refleja en el consumo eléctrico de los centros de datos. Los centros de datos generan un calor inmenso que debe disiparse con agua dulce. Se calcula que por cada kWh consumido en un centro de datos se necesitan unos 2 litros de agua para refrigeración. Una sesión de 10 a 50 respuestas con ChatGPT puede equivaler a la evaporación de medio litro de agua dulce.

No solo es electricidad. Los centros de datos necesitan millones de litros de agua para refrigerar los servidores que procesan tus prompts. En zonas de escasez hídrica, esto plantea un debate ético profundo: ¿priorizamos el enfriamiento de los chips o el riego de las comunidades?

De la “IA roja” a la “IA verde” (green AI)

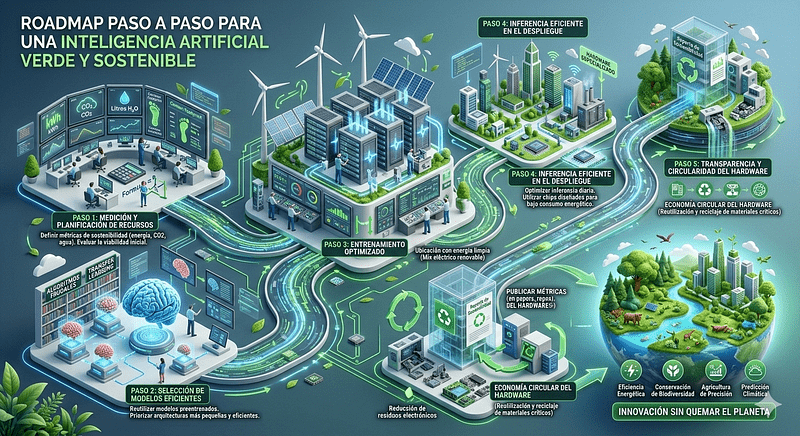

Medir el impacto ambiental de la inteligencia artificial es esencial para avanzar hacia una IA verde. El futuro no se trata de dejar de usar la IA, sino de hacerla eficiente por diseño. Aquí es donde entra la verdadera maestría técnica:

- Algoritmos frugales: modelos que logran lo mismo con menos parámetros; por consiguiente, buscan reducir el impacto ambiental de la inteligencia artificial.

- Hardware especializado: chips diseñados para consumir una fracción de la energía actual.

- Transparencia de carbono: que cada desarrollador sepa cuántos gramos de CO2 emite su línea de código.

Por qué importa la huella de entrenar grandes modelos

- Entrenamiento intensivo: entrenar modelos con miles de millones de parámetros puede requerir semanas de GPU/TPU, multiplicando el consumo eléctrico.

- Emisiones asociadas: la electricidad consumida se traduce en emisiones según la mezcla energética del lugar donde se entrena. Medir kWh → CO₂ es esencial.

- Impactos colaterales: refrigeración, fabricación de hardware y replicación de experimentos aumentan la huella total.

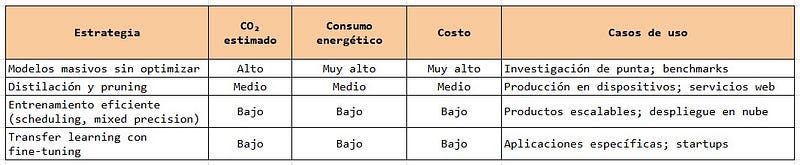

Tabla comparativa de estrategias de entrenamiento

Guía práctica de cómo medir la huella de un entrenamiento

Consideraciones iniciales:

- Duración del entrenamiento en horas.

- Potencia promedio del hardware en kW.

- Factor de emisiones del mix eléctrico local en kgCO₂/kWh.

- Overhead por refrigeración y datacenter (añadir un 10–30% según caso).

Fórmula básica

- Energía total E en kWh: E=potencia (kW)⋅horas

- Emisiones C en kgCO₂: C=E⋅factor_emisiones (kgCO₂/kWh)⋅(1+overhead)

Ejemplos

Estimador en Python

# Estimador simple de energía y CO2 para un experimento de entrenamiento

power_kw = 3.5 # potencia promedio de la máquina en kW (ej. 3.5 kW para 8 GPUs)

hours = 72 # duración del entrenamiento en horas

emission_factor = 0.4 # kgCO2 per kWh (valor ejemplo; varía por región)

overhead = 0.2 # 20% extra por refrigeración y datacenter

energy_kwh = power_kw * hours

total_energy = energy_kwh * (1 + overhead)

co2_kg = total_energy * emission_factor

print(f"Energía estimada: {energy_kwh:.1f} kWh")

print(f"Energía total con overhead: {total_energy:.1f} kWh")

print(f"Emisiones estimadas: {co2_kg:.1f} kg CO2")Lenguaje del código: PHP (php)Explicación:

- power_kw: potencia media de la máquina durante el entrenamiento.

- hours: tiempo total de cómputo.

- emission_factor: depende del país o región; usar fuentes locales para precisión.

- Resultado: energía directa, energía con overhead y emisiones en kgCO₂.

Registro y trazabilidad con MLflow

!pip install mlflowimport mlflow

mlflow.start_run()

mlflow.log_param("power_kw", power_kw)

mlflow.log_param("hours", hours)

mlflow.log_metric("energy_kwh", energy_kwh)

mlflow.log_metric("co2_kg", co2_kg)

mlflow.end_run()Lenguaje del código: CSS (css)Explicación: registrar parámetros y métricas permiten comparar experimentos y priorizar configuraciones más eficientes.

Optimización: mixed precision y reducción de batch

import torch

import torch.nn as nn

# Define a simple dummy model

class MyModel(nn.Module):

def __init__(self):

super().__init__()

self.linear = nn.Linear(10, 1)

def forward(self, x):

return self.linear(x)

# Dummy data and parameters

model = MyModel()

optimizer = torch.optim.Adam(model.parameters(), lr=1e-4)

scaler = torch.cuda.amp.GradScaler() # mixed precision

epochs = 5

dummy_input = torch.randn(32, 10) # Batch size 32, 10 features

dummy_target = torch.randn(32, 1) # Batch size 32, 1 target

dataloader = [(dummy_input, dummy_target)] # A very simple dataloader

for epoch in range(epochs):

print(f"Epoch {epoch+1}/{epochs}")

for x, y in dataloader:

with torch.cuda.amp.autocast():

output = model(x)

loss = nn.MSELoss()(output, y)

scaler.scale(loss).backward()

scaler.step(optimizer)

scaler.update()

print(f" Loss: {loss.item():.4f}")

print("Mixed precision training example completed.")Explicación:

- mixed precision reduce uso de memoria y tiempo por paso, disminuyendo consumo energético.

- Ajustar batch size y learning rate puede reducir epochs necesarios.

Estrategias para reducir la huella

- Medir siempre: sin métricas no hay mejora. Registrar energía y CO₂ por experimento.

- Optimizar arquitectura y entrenamiento: pruning, distillation, quantization y mixed precision.

- Transfer learning: reutilizar modelos preentrenados y hacer fine-tuning localmente.

- Elegir ubicación y horario: entrenar donde la electricidad sea más limpia o en horarios con mayor aporte renovable.

- Transparencia: publicar métricas de consumo en papers y repositorios para crear incentivos.

La IA puede ser una herramienta poderosa para la sostenibilidad si la diseñamos con criterios ambientales desde el inicio. Medir, optimizar y transparentar no son solo buenas prácticas técnicas; son imperativos éticos para que la innovación no deje una factura climática que paguen las generaciones futuras.

El impacto positivo

A pesar de su costo ambiental, la IA ofrece soluciones que podrían facilitar el cumplimiento del 93% de los objetivos de desarrollo sostenible medioambientales.

- Eficiencia energética y recursos: los algoritmos pueden optimizar redes eléctricas inteligentes, permitiendo una mejor integración de fuentes renovables (solar y eólica) y reduciendo el desperdicio de energía.

- Conservación de la biodiversidad: se utiliza IA para monitorizar especies en peligro mediante drones y cámaras trampa, detectar la deforestación en tiempo real y combatir la caza furtiva.

- Agricultura de precisión: permite a los agricultores monitorizar cultivos, optimizar el uso de agua y minimizar químicos, mejorando la salud del suelo y el rendimiento de manera sostenible.

- Predicción climática: mejora los modelos de predicción de desastres naturales (incendios, inundaciones) y ayuda a entender mejor los patrones del cambio climático.

El precio de la omnisciencia

La IA tiene el potencial de optimizar redes eléctricas, diseñar materiales biodegradables y predecir catástrofes climáticas. Es nuestra mejor herramienta para salvar el planeta, pero no podemos salvar el mundo quemándolo en el proceso.

Para mitigar los efectos negativos, los expertos proponen avanzar hacia una IA sostenible. Esto implica priorizar algoritmos energéticamente eficientes, utilizar centros de datos alimentados por energías renovables y aplicar la economía circular al hardware para prolongar su vida útil. En España, por ejemplo, el Programa Nacional de Algoritmos Verdes (PNAV) busca fomentar el desarrollo de tecnología digital avanzada que sea respetuosa con el entorno.

La sostenibilidad no es un “plus” en el desarrollo de IA; es el requisito mínimo de supervivencia. ¿Estamos dispuestos a sacrificar velocidad por sostenibilidad?