Dimenticate l’idea romantica del cronometro premuto a bordo pista e del giudice con il taccuino. Le Olimpiadi Invernali di Milano Cortina 2026 non sono state soltanto un grande evento sportivo ma hanno rappresentato il nuovo limite raggiunto dalle infrastrutture digitali più complesse mai orchestrate su scala globale.

Mentre la maggior parte delle persone diventa esperta di curling, snowboard e short track, gli occhi di chi scrive codice non vedono una competizione su ghiaccio e neve, ma una piattaforma distribuita, real-time, mission critical. Un sistema fatto di pipeline di Computer Vision che lavorano a decine di migliaia di frame al secondo, architetture cloud iperperformanti, edge computing sparso sulle Alpi e modelli di sicurezza Zero Trust progettati per difendere ogni singolo bit.

Dicevamo del mitico cronometrista seduto su uno sgabello col cappellino in testa, anonimo eroe che in base al proprio stato psico-fisico poteva alterare di decimi preziosi le prestazioni degli atleti.

Nel mondo del timing sportivo, i brand storici si sono trasformati in laboratori di innovazione applicata. Il gruppo Swatch che possiede tra gli altri Rolex e Omega, specialmente con quest’ultimo marchio, ha messo in campo dei veri game changer. Con il sistema Scan’O’Vision ULTIMATE, si parla di acquisizione fino a 40.000 immagini al secondo. Per chi lavora in ambito Computer Vision, il dato fa più impressione della gara stessa.

Quarantamila frame al secondo significano throughput elevatissimi, latenza minima, elaborazione distribuita. Non è possibile pensare di portare tutto in un data center remoto e aspettare che funzioni. Serve edge computing: GPU locali, acceleratori, pipeline ottimizzate per l’inferenza in tempo reale, con risultati strabilianti.

Per non parlare delle gare dove più che la bravura ha sempre contato anche molto la ‘politica’ tra i vari giudici di gara.

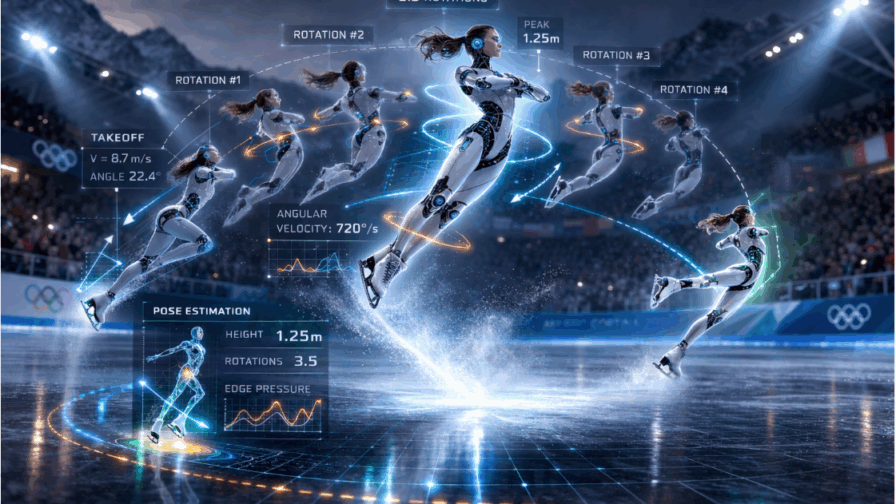

Nel pattinaggio artistico, la differenza tra un salto valido e uno imperfetto può stare in pochi millisecondi e in qualche grado di rotazione. Ma quest’anno i modelli di ‘pose estimation’ non si sono limitati a “seguire” l’atleta: hanno ricostruite geometrie tridimensionali, calcolato angoli, stimato altezze di stacco e numero di rotazioni con una precisione che ha ridotto veramente al minimo la componente soggettiva.

Nello sci alpino e nel salto, la visione artificiale ha generato mappe di movimento tridimensionali quasi istantanee. L’analisi biomeccanica è diventata un flusso continuo di feature estratte automaticamente: distribuzione del peso, inclinazione, traiettorie ottimali. Non è stato più video-analisi a posteriori, ma data analysis in corsa.

I wearable non sono spariti, ma hanno cambiato ruolo. Restando fondamentali in fase di allenamento, dove smart clothing e dispositivi rugged monitorano parametri fisiologici in condizioni estreme. A -20 o -30 gradi non basta certo il vostro smartwatch consumer: servono device progettati per sopravvivere in condizioni a dir poco estreme.

Data Engineering in tempo reale: il CI/CD della performance

Chi si occupa di data analisys anche solo di straforo sa che raccogliere dati è solo il primo step. Il vero discriminante sta nella latenza tra acquisizione, elaborazione e decisione.

Nel bobsled e nello skeleton ( si chiama così perchè la slitta è ridotta ai minimi termini, non perchè è molto facile arrivare cadaveri, ho controllato), l’analisi tra una manche e l’altra è una corsa contro il tempo. I dati sulle linee di spinta, sull’aerodinamica e sulle micro-variazioni di traiettoria vengono caricate in piattaforme cloud come Snowflake, elaborati e restituiti ai coach quasi in tempo reale.

È un ciclo di feedback continuo. Se vogliamo usare una metafora familiare a chi sviluppa software, è un CI/CD applicato alla performance atletica. Ogni run è una release, ogni correzione è una patch.

E il curling? Probabilmente lo sport più sottovalutato dal punto di vista tecnologico nasconde un sacco di sorprese. Le nuove “pietre intelligenti” integrano sensori che rilevano traiettoria, rotazione, velocità. Sotto il ghiaccio, strip magnetiche o sistemi di rilevamento dialogano con le ‘stone’ per determinare automaticamente violazioni come la hog-line. A me risulta molto più facile capire come i sensori passano i dati ai server piuttosto che alcune regole di questo sport, ma molti spettatori giurano che dopo quindici minuti passati in tribuna con Snoop Dogg, tutto diventa molto più chiaro e semplice, da stone a stoned è un attimo.

Il risultato di tutti questi dati non è solo arbitraggio più preciso, ma una narrazione aumentata per lo spettatore. Overlay grafici, vettori, simulazioni fisiche in tempo reale. Il ghiaccio diventa un canvas, quasi una dashboard, con un effetto veramente gradevole. Su tutti gli overlay di Alysa Liu, ascoltare Donna Summer senza rivedere le sue evoluzioni esplose sulla pista da adesso in poi, sarà molto difficile

Cloud Broadcasting: la regia è virtuale

Se lato performance vediamo l’AI entrare nel gesto tecnico, lato broadcasting assistiamo a una trasformazione silenziosa ma radicale.

L’Olympic Broadcasting Services (la struttura del Comitato Olimpico Internazionale deputata a svolgere il ruolo di radio-televisione ufficiale per tutte le competizioni olimpiche ) ha progressivamente virtualizzato parti rilevanti della produzione. Le classiche OB Van, i camion regia parcheggiati fuori dagli impianti, cedono spazio a Virtual OB Vans in cloud. Invece di inviare un enorme camion pieno di macchinari sul luogo dell’evento, si inviano solo le telecamere e gli encoder, mentre la “regia” (mix video/audio, grafica, replay) avviene su server remoti, solitamente gestiti su piattaforme cloud come AWS o Google Cloud. Le telecamere sul posto inviano i feed video/audio via internet (spesso utilizzando il bonding cellulare o reti IP) a un’istanza cloud. Lì, operatori remoti gestiscono la produzione tramite interfacce software che simulano le console fisiche (switchers, mixer audio).

Oltre a eliminare la necessità di parcheggi enormi per i camion, generatori di corrente e il trasporto fisico di tonnellate di apparecchiature, si passa da un modello CAPEX (investimento in capitale per camion) a un modello OPEX (spesa operativa, “pay-as-you-go”), pagando solo per le risorse cloud utilizzate durante l’evento. Inoltre è possibile attivare risorse di elaborazione illimitate in base alla complessità dell’evento, cosa impossibile con i limiti di spazio di un camion fisico mentre il personale di produzione può lavorare da qualsiasi luogo, anche da casa o da un ufficio centrale, riducendo le spese di viaggio e logistica.

Tutto questo significa scalabilità on demand, riduzione dell’hardware fisico in loco e un’impronta energetica più sostenibile. tutte quello che volevate da un DevOps è non avete mai osato chiedere: infrastruttura distribuita, workload elastici, orchestrazione di flussi video ad altissima banda.

La user experience si spinge oltre la ‘semplice’ diretta. Droni FPV inseguono gli atleti nelle discese, generando prospettive immersive a bassa latenza. Sistemi di replay a 360 gradi ricostruiscono l’azione combinando i feed di decine di camere. La scena si congela, la visuale ruota attorno all’atleta sospeso in aria, e tutto avviene grazie a pipeline di elaborazione che girano su infrastrutture cloud ad alte prestazioni.

E, per quelli a cui ancora non bastava, su Olympics.com, assistenti conversazionali permettevano di interrogare statistiche, regolamenti e risultati in linguaggio naturale. Non è solo una feature per il pubblico: è un altro layer applicativo che si integra con database, sistemi di caching e modelli NLP, in un ecosistema dove ogni endpoint conta.

Zero Trust: sicurezza come architettura, non come accessorio

Un’infrastruttura così distribuita e interconnessa amplia inevitabilmente la superficie di attacco. Flussi video, dati biometrici, telemetria, piattaforme cloud: ogni componente è un potenziale target.

Qui entra in gioco il paradigma Zero Trust. Non esiste più un perimetro sicuro. Ogni dispositivo, ogni telecamera, ogni drone deve autenticarsi, essere verificato, autorizzato. La rete viene micro-segmentata, i privilegi sono minimizzati, l’accesso è continuamente validato.

Player come Hewlett Packard Enterprise e Juniper Networks hanno contribuito alla costruzione di architetture dove la sicurezza è nativa, non un layer aggiunto a posteriori.

L’AI, ancora una volta, ha giocato un ruolo centrale. I modelli hanno analizato pattern di traffico e cercato anomalie in tempo reale. Un attacco DDoS durante una finale olimpica non è solo un problema tecnico: è un incidente globale. La difesa doveva essere proattiva, capace di reagire prima che l’utente finale si accorgesse di qualcosa. Difficile sapere se qualcosa non ha funzionato o se ci sono stati attacchi degni di questo nome, al solito gli intoppi e le gaffe più clamorose sono arrivate dal fattore umano, ma altrimenti si rischiava anche un po di annoiarsi.

Il codice è parte della squadra

Personalmente mi è dispiaciuto che tutto questo lavoro dietro le quinte non sia stato premiato adeguatamente.

Dietro ogni centesimo di secondo guadagnato c’è stato un modello ottimizzato, una query migliorata, una pipeline resa più efficiente. Dietro ogni replay immersivo un team che ha progettato un workflow scalabile. Dietro ogni flusso sicuro un’architettura Zero Trust pensata per reggere milioni di richieste simultanee.

Accendendo la TV o aprendo uno stream per seguire una discesa libera, abbiamo visto neve, ghiaccio e adrenalina. Ma sotto la superficie c’era una piattaforma software globale che lavorava in silenzio, orchestrando dati, immagini e decisioni in tempo reale, abbiamo pianto con la Lollobrigida ma anche Jordan Cowan ci ha fatto emozionare tantissimo.

A Hollywood l’anno prossimo introdurranno il premio Oscar come miglior stunt man, chissà che un giorno non diano una medaglia anche al miglior DBA per la query più veloce delle olimpiadi, medaglia rigorosamente di rame…