Per molti sviluppatori l’intelligenza artificiale applicata alla guida autonoma non nasce dentro un laboratorio pieno di sensori costosissimi, ma davanti a uno schermo, con un simulatore open source apparentemente innocuo e una quantità imbarazzante di errori iniziali. È una dinamica quasi inevitabile: quando si parla di AI che deve prendere decisioni in tempo reale, reagire a un ambiente dinamico e imparare dai propri fallimenti, il mondo virtuale diventa il posto perfetto dove sperimentare senza distruggere automobili vere nel processo.

Ed è qui che TORCS (The Open Race Car Simulator) continua a dimostrarsi incredibilmente attuale.

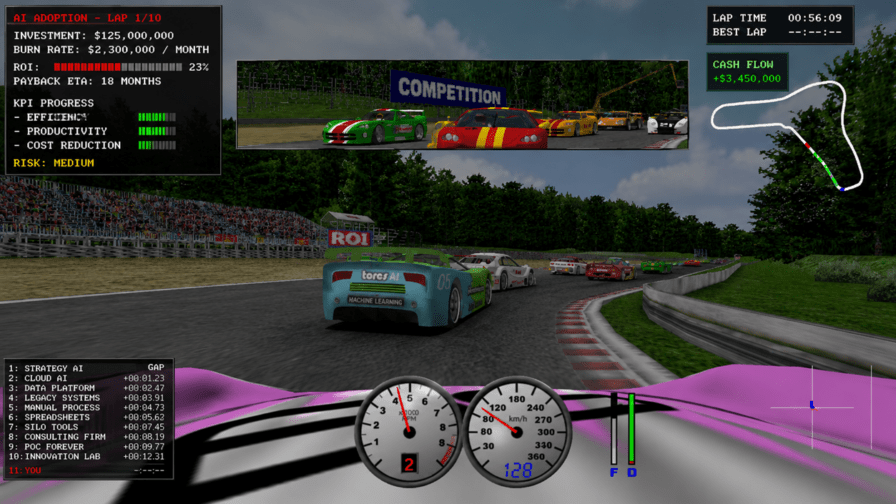

A prima vista TORCS sembra arrivare direttamente da un’altra epoca. L’interfaccia ha quell’estetica da simulatore PC dei primi anni Duemila che oggi produce immediatamente nostalgia tecnica, soprattutto in chi è cresciuto tra LAN party, joystick improbabili e workstation assemblate in casa. Ma sarebbe un errore gigantesco fermarsi alla grafica.

Perché sotto quell’aspetto vintage si nasconde ancora uno degli ambienti più interessanti per introdurre concetti di AI, reinforcement learning e simulazione realtime.

Ed è esattamente quello che abbiamo fatto a Salerno durante alcune attività collegate alla IBM AI Race League, usando il simulatore non come videogioco ma come laboratorio sperimentale per parlare di agenti intelligenti, telemetria, apprendimento automatico e sistemi decisionali.

La cosa curiosa è che il motorsport virtuale riesce dove spesso molte lezioni teoriche falliscono: rende immediatamente visibile il comportamento dell’AI.

Quando un agente sbaglia una curva, finisce contro un guard rail o impara improvvisamente a gestire meglio una traiettoria, il concetto di apprendimento automatico smette di essere astratto. Diventa qualcosa che puoi osservare in diretta, curva dopo curva.

Ed è qui che Python entra in scena.

Python è stato il ponte perfetto tra simulazione e AI. Attraverso semplici interfacce socket, TORCS esponeva continuamente dati relativi alla vettura: velocità, posizione, angolo rispetto alla pista, distanza dai bordi, accelerazione, collisioni. L’agente sviluppato in Python riceveva questi input e decideva come reagire, controllando sterzo, acceleratore e frenata.

Il risultato era una sorta di dialogo continuo tra simulatore e intelligenza artificiale. TORCS mostrava lo stato del mondo, l’agente rispondeva con un’azione, il motore fisico aggiornava la simulazione e tutto ricominciava da capo decine di volte al secondo.

È una dinamica che oggi ricorda moltissimo i moderni sistemi agentici enterprise di cui si parla ovunque, solo che qui il problema da risolvere non era organizzare ticket o interrogare API aziendali, ma evitare che una Ferrari virtuale finisse contro un muro a 250 km/h.

Ed è sorprendente quanto il reinforcement learning diventi intuitivo quando lo si osserva in un contesto del genere.

In teoria il concetto è semplice: l’agente compie azioni, riceve ricompense o penalità e nel tempo impara quali comportamenti siano più vantaggiosi. In pratica significa passare ore a vedere automobili virtuali prendere decisioni assurde prima di iniziare lentamente a sviluppare una logica di guida quasi credibile.

La parte più interessante è che l’agente non riceve istruzioni dettagliate del tipo “sterza qui” o “frena adesso”. Nessuno gli insegna davvero a guidare. Deve scoprirlo da solo, cercando di massimizzare le reward e minimizzare gli errori.

È un approccio affascinante perché mostra chiaramente uno degli aspetti più controintuitivi dell’AI moderna: spesso l’intelligenza emerge da una lunga sequenza di tentativi falliti.

E TORCS, in questo senso, è quasi perfetto. È abbastanza realistico da creare problemi complessi, ma sufficientemente leggero da permettere iterazioni rapide e sperimentazione continua. Non richiede infrastrutture gigantesche, GPU da datacenter o simulatori fotorealistici ingestibili. Permette di concentrarsi sull’agente.

A Salerno questa cosa è emersa in maniera molto evidente. All’inizio molti partecipanti vedevano il simulatore come un semplice ambiente di gioco. Dopo poco tempo iniziavano invece a ragionare in termini di comportamento emergente, reward engineering e strategie decisionali.

Le discussioni cambiavano rapidamente tono. Non si parlava più soltanto di codice, ma di come “premiare” correttamente un comportamento utile, di come evitare che l’agente trovasse scorciatoie assurde o sviluppasse strategie completamente sbagliate pur ottenendo reward positive.

Ed è probabilmente uno degli aspetti più sottovalutati del reinforcement learning: progettare bene le ricompense è spesso più difficile che scrivere l’agente stesso.

La IBM AI Race League è stata particolarmente interessante proprio perché riusciva a mescolare competizione, AI e sperimentazione tecnica in modo molto naturale. La componente “gaming” abbassava immediatamente la barriera iniziale, ma dietro la parte ludica emergevano rapidamente problemi molto vicini a quelli affrontati oggi nei sistemi autonomi reali.

Perché alla fine il problema è sempre lo stesso: osservare un ambiente, prendere decisioni in condizioni incerte e adattarsi continuamente ai cambiamenti.

E in questo senso il collegamento con il mondo enterprise arriva quasi automaticamente.

Durante le attività abbiamo spesso trasformato la gara in una scusa per introdurre temi molto più ampi. Ogni vettura diventava una sorgente dati continua, una specie di dispositivo IoT mobile che produceva telemetria realtime. Da lì il passaggio verso pipeline dati, analytics e dashboard era praticamente immediato.

A quel punto TORCS smetteva definitivamente di essere “solo” un simulatore automobilistico. Diventava un piccolo ecosistema distribuito in cui parlare di streaming dati, monitoring, osservabilità e AI decisionale.

Ed è forse questo il motivo per cui strumenti apparentemente vecchi continuano ad avere così tanto valore educativo. Non perché siano tecnologicamente perfetti, ma perché riescono a rendere comprensibili concetti enormemente complessi.

Oggi l’intelligenza artificiale viene spesso raccontata quasi esclusivamente attraverso chatbot e modelli generativi. Ma una parte enorme dell’AI moderna riguarda ancora agenti autonomi, simulazioni, pianificazione dinamica e sistemi che devono interagire continuamente con il mondo circostante.

TORCS continua a essere sorprendentemente vivo.

Perché vedere un agente imparare a guidare, sbagliare cento volte la stessa curva e poi improvvisamente iniziare a comportarsi in modo credibile produce un effetto molto diverso rispetto a leggere una formula su una slide.

Rende l’AI concreta: un vecchio simulatore open source riesce a trasformarsi in una delle palestre più efficaci per parlare di intelligenza artificiale moderna.