C’è un momento preciso in cui un gioco smette di essere solo un gioco. Noi lo abbiamo trovato a Sanremo, nel bel mezzo di un esperimento con Gemini, il modello di intelligenza artificiale di Google, mentre cercavamo di capire chi avrebbe vinto la settantaseiesima edizione del Festival. Sembrava un esercizio innocuo, quasi frivolo. E in parte lo era. Ma quello che è emerso dall’analisi racconta qualcosa di molto più serio: racconta come ragiona una macchina, dove sbaglia, e perché dovreste diffidare di chiunque vi proponga la stessa ricetta applicata ai vostri dati aziendali. Le AI non sono oracoli. Sono specchi sofisticati che riflettono pattern del passato. A Sanremo il prezzo dell’errore è una previsione sbagliata. Sui vostri dati, potrebbe costare molto di più.

Come ragiona una macchina: il metodo Gemini

Tutto inizia con una serie di istruzioni precise. Abbiamo chiesto a Gemini di analizzare i dati Auditel, i flussi di ascolto su Spotify e Apple Music, le visualizzazioni YouTube dei videoclip ufficiali, i trend di ricerca su Google, i voti parziali delle giurie istituzionali, i vincitori degli ultimi dieci anni, le quotazioni dei bookmakers e, dettaglio che rivela quanto il modello sia sofisticato nel suo approccio, gli autori e i produttori dei brani vincitori nell’ultimo decennio. L’idea era costruire non solo una fotografia del presente, ma una mappa del DNA del successo sanremese.

La risposta di Gemini non è stata un semplice “secondo me vince X”. È stato un report di analisi strutturato in dieci sezioni, con tabelle comparative, pesi ponderati per ciascuna giuria e persino uno studio longitudinale dell’evoluzione del Festival dal 2016 al 2025. Il tono era quello di un analista finanziario di alto livello, non di un appassionato di musica leggera.

Il modello ha identificato correttamente alcune delle forze che governano la competizione. Ha ricostruito, per esempio, come la vittoria di Mahmood nel 2019 con “Soldi”, grazie alla produzione di Dardust e Charlie Charles, abbia sancito il dominio dello streaming sulle vendite fisiche e inaugurato l’era in cui il pop “indie” e urban smette di essere una nicchia. Ha tracciato la traiettoria dei Måneskin nel 2021, il trionfo di Mahmood e Blanco nel 2022 con “Brividi” (record di streaming nelle prime 24 ore), fino alla vittoria di Olly nel 2025 con “Balorda Nostalgia”, costruita sul delicato equilibrio tra chitarre acustiche, pianoforte e beat elettronico stratificato.

Dall’analisi storica, Gemini ha estratto una legge quasi matematica: il brano vincitore non è mai il frutto di un’intuizione solitaria, ma il risultato di un’architettura produttiva progettata con chirurgica precisione. E ha applicato questa legge al cast del 2026, scoprendo un sistema oligopolistico in cui pochi autori, Federica Abbate, Alessandro La Cava, Davide Petrella, Dardust, firmano più brani in gara simultaneamente, come una casa discografica che scommette su più cavalli nella stessa corsa.

Il meccanismo del voto nella finale è stato scomposto in tre vettori: il Televoto (34%), la Giuria della Sala Stampa (33%) e la Giuria delle Radio (33%). Un sistema progettato, almeno sulla carta, per punire i candidati estremi, forti in una sola categoria, e premiare la consistenza multifattoriale. Gemini lo aveva capito bene.

Sappiamo bene che ogni anno i vincitori di Sanremo arrivano con il loro corredo di teorie, retroscena e sussurri nei corridoi. La nostra è un’analisi dei dati. Il resto lo lasciamo volentieri al gossip.

La previsione: tre candidati, una logica ineccepibile

Dopo aver setacciato dati Auditel, classifiche Spotify, tendenze YouTube, passaggi monitorati da EarOne (la piattaforma italiana leader per il monitoraggio in tempo reale dei passaggi radiofonici e televisivi) e quote dei bookmaker, Gemini ha prodotto una previsione articolata, coerente, internamente impeccabile.

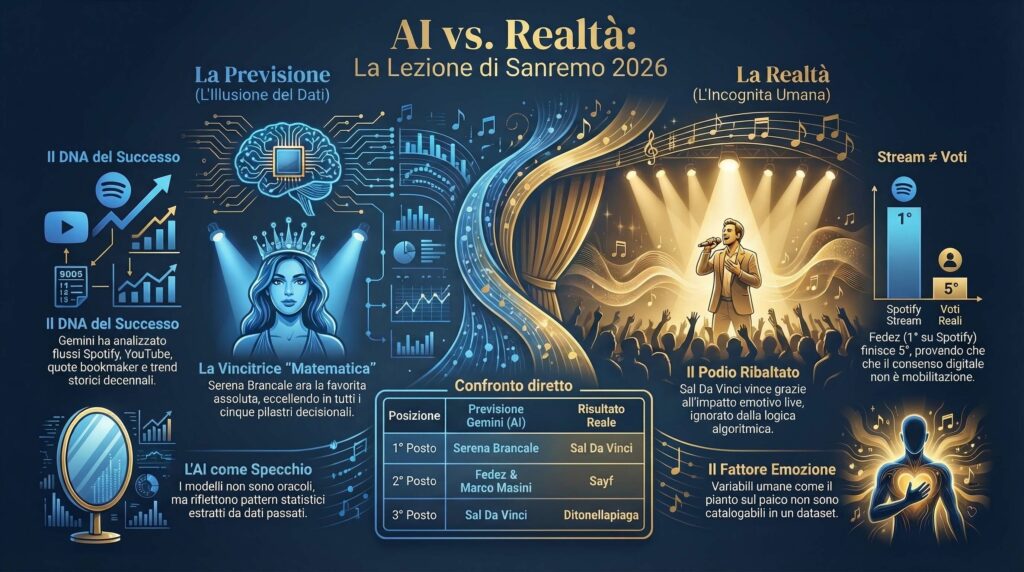

Vincitrice prevista: Serena Brancale. La cantautrice pugliese era, secondo il modello, l’unica artista capace di registrare eccellenza su tutti e cinque i pilastri decisionali: nella Top 5 qualitativa della Sala Stampa fin dalla prima serata, solida nella Top 5 aggregata di Televoto e Radio, al secondo posto per impatto visivo su YouTube, guida nelle classifiche dei nuovi ingressi radiofonici tracciati da EarOne, unanimemente sostenuta dai bookmaker con quote tra 2.85 e 3.50. Il suo brano, un’elegia dedicata alla figura materna, aveva conquistato una standing ovation che, scriveva Gemini, “sfugge a misurazioni puramente numeriche ma certifica un trionfo emotivo tangibile”. Il modello l’aveva coronata con la stessa certezza con cui un computer degli anni Settanta dichiarava di aver risolto il problema degli scacchi.

Secondo classificato previsto: Fedez & Marco Masini. Il sodalizio inedito era descritto come “il capolavoro tattico e di marketing dell’edizione 2026”: primo assoluto su Spotify con circa un milione di stream giornalieri, presente nella Top 5 della Stampa e in quella del Televoto, il brano firmato firmato dalla coppia Abbate/La Cava, due del ristretto gruppo di vincitori seriali. Il brano affrontava la vulnerabilità emotiva e la paternità, temi che, notava giustamente il modello, generano un tasso di condivisione superiore alla classica tematica amorosa.

Terzo classificato previsto: Sal Da Vinci. Qui Gemini mostrava una lucidità parziale: riconosceva il fenomeno sociologico del cantautore partenopeo, primo assoluto su YouTube con oltre 649.000 visualizzazioni, brano prodotto dagli stessi autori di Fedez/Masini, ma lo relegava al bronzo, convinto che la Sala Stampa avrebbe eretto un muro invalicabile contro la sua estetica neomelodica. Un pregiudizio, si sarebbe rivelato, non del tutto fondato.

Degni di nota anche gli altri nomi inseriti nella cinquina ipotetica: Arisa, blindata dal favore critico ma con streaming relativamente tiepidi; Sayf, l’underdog della Generazione Z con quasi un milione di ascolti giornalieri su Spotify ma ignorato dalla Sala Stampa.

Quello che è successo davvero: previsione vs. realtà

E poi è arrivata la finale. E la realtà ha deciso, come sempre, di non leggere i report di analisi.

Sal Da Vinci ha vinto con il 22,2% del punteggio ponderato finale. Sayf è arrivato secondo con il 21,9%. Ditonellapiaga terza con il 20,6%. Arisa quarta con il 18,9%. Fedez e Masini quinti con il 16,5%. E Serena Brancale, la “vincitrice designata” con una certezza statistica quasi assoluta? Nona.

Occorre però leggere questi risultati con onestà, senza trasformare il post-mortem in un semplice processo agli errori. Perché Gemini non aveva sbagliato tutto. Quattro dei cinque artisti presenti nella cinquina reale erano stati identificati dal modello come candidati rilevanti, Sal Da Vinci, Sayf, Arisa e Fedez/Masini erano tutti nella rosa degli analizzati con attenzione. Il problema non era la mappa del territorio, era la scala delle probabilità. Come un meteorologo che prevede correttamente i fronti in gioco ma si sbaglia sulla traiettoria, Gemini aveva visto i giocatori ma frainteso le forze che li avrebbero mossi.

Dove, allora, il modello ha mancato il bersaglio in modo più clamoroso?

Il primo errore riguarda Sal Da Vinci e la Sala Stampa. Gemini aveva ipotizzato che i giornalisti avrebbero penalizzato il brano neomelodico partenopeo. Non è andata così. La potenza interpretativa dal vivo di Sal Da Vinci ha generato un’empatia trasversale che ha convinto la critica a premiarlo nonostante le riserve estetiche iniziali. Nel televoto puro, peraltro, aveva perso: Sayf aveva ottenuto il 26,4% contro il 23,6% di Sal Da Vinci. La sua vittoria finale è avvenuta proprio grazie al supporto di stampa e radio, esattamente il contrario di quanto previsto dal modello.

Il secondo errore riguarda la conversione degli stream in voti SMS. Fedez e Masini dominavano Spotify con circa un milione di ascolti quotidiani, eppure nella finale hanno raccolto soltanto l’11,9% del televoto. Chi ascolta una canzone in streaming non necessariamente vota, e una fanbase digitale non è automaticamente una fanbase mobilitata. È una distinzione che sembra ovvia ma che i modelli predittivi tendono a ignorare perché i dati di streaming sono numericamente seduttivi, facili da misurare, difficili da interpretare nel contesto giusto.

Il terzo errore, forse il più istruttivo, riguarda i bookmaker e la trappola della conferma collettiva. Le agenzie di scommesse davano Brancale come netta favorita. Gemini le ha credute. Ma i bookmaker operano su flussi di denaro che riflettono la percezione mediatica delle prime serate, tendono a fotografare l’entusiasmo iniziale più che l’evoluzione dinamica del consenso nelle notti successive. Il risultato finale di Brancale al nono posto è la dimostrazione che nemmeno il mercato, con tutte le sue presunte capacità di aggregazione dell’informazione, riesce a prevedere la complessità emotiva di una finale televisiva.

Ditonellapiaga, esclusa dal podio previsto perché ritenuta forte in radio ma debole al televoto, ha invece saputo saldare le due dimensioni: 18,9% al televoto sommato all’enorme supporto radiofonico l’ha portata al terzo posto reale. Il modello l’aveva identificata come un’ottima outsider ma aveva sottostimato la capacità di un brano fortemente ritmato di conquistare il pubblico da casa una volta arrivata la serata finale.

L’oracolo e i vostri dati: perché questo conta davvero

Sanremo era un gioco. Ma il meccanismo che ha prodotto questi errori non è esclusivo di Sanremo. È il meccanismo di qualsiasi sistema predittivo basato su intelligenza artificiale, applicato a qualsiasi dominio: finanza, marketing, risorse umane, previsioni di vendita, analisi del rischio.

Le AI, compresi i modelli più avanzati come Gemini, ChatGPT o Claude, lavorano su pattern statistici estratti da dati storici. Sono eccezionalmente brave a riconoscere regolarità, a comprimere complessità, a identificare correlazioni che un analista umano impiegherebbe settimane a trovare. Il report di Gemini su Sanremo era, da questo punto di vista, una performance impressionante: aveva mappato con precisione il DNA dei vincitori dell’ultimo decennio, aveva identificato i fattori strutturali del successo, aveva costruito un modello interno coerente e ben argomentato.

Il problema non è la qualità dell’analisi. Il problema è che il futuro non è nei dati storici. O meglio: i dati storici ci dicono cosa è successo e in quali condizioni. Non ci dicono come si comporteranno le variabili nuove, l’esibizione live che genera un’emozione inattesa, il momento in cui un pubblico decide di ribellarsi alla logica del gradimento costruito, la mobilitazione di una fanbase che non era stata considerata abbastanza determinata.

Quello che Gemini non poteva sapere, e che nessun modello avrebbe potuto sapere prima della finale, è che Sal Da Vinci avrebbe pianto sul palco dell’Ariston, che quel momento sarebbe diventato virale sui social network, che quell’emozione non sarebbe rimasta confinata al pubblico nazional-popolare ma avrebbe attraversato le barriere demografiche e convinto anche la critica a riscrivere le sue gerarchie estetiche. Le variabili umane, quelle che emergono dall’irripetibilità di un momento, non sono catalogabili in un dataset.

Il debrief di Gemini sui propri errori, che il modello ha prodotto autonomamente quando gli abbiamo mostrato i risultati reali, è stato di rara lucidità. Ha identificato con precisione i tre punti di cedimento: la sopravvalutazione dei bookmaker, la traduzione acritica degli stream in potere di televoto, il pregiudizio estetico sulla Sala Stampa. È riuscito, in sostanza, a fare un’ottima analisi del passato prossimo. Ma questo è un’abilità diversa, e di valore differente, rispetto alla previsione del futuro.

Ecco il punto che conta: se qualcuno vi propone un sistema di intelligenza artificiale in grado di “prevedere” l’andamento dei vostri clienti, le performance dei vostri venditori, il successo del vostro prossimo prodotto, con la stessa sicurezza con cui Gemini aveva incoronato Serena Brancale, la domanda giusta da fare non è “quanto è preciso il modello?” ma “su quali dati è stato addestrato, e quali variabili non è in grado di vedere?”. I modelli vi danno risultati in base a come vengono istruiti e a cosa viene loro mostrato. Cambiate i dati di input, cambieranno le previsioni. Non perché il modello sia stupido, ma perché nessun modello vede ciò che non gli è stato dato da vedere.

L’intelligenza artificiale è uno strumento potente per ridurre l’incertezza, non per eliminarla. Chi ve la vende come oracolo sta facendo marketing, non scienza. E la differenza, nel momento in cui ci appoggiate decisioni importanti, può essere molto costosa.

Cosa cambierebbe per il 2027: il modello che impara

Il capitolo finale di questa storia è forse il più interessante, perché mostra esattamente come un sistema predittivo dovrebbe evolversi dopo un fallimento. Abbiamo chiesto a Gemini di costruire un documento strategico per Sanremo 2027, e il modello ha risposto con una serie di correzioni metodologiche che valgono come lezione generale.

Per il prossimo anno, il modello suggerisce di pesare molto di più l’impatto emotivo delle esibizioni dal vivo rispetto ai dati pre-Festival: una standing ovation all’Ariston, ha capito Gemini, vale più di mille stream su Spotify nel momento in cui la Sala Stampa deve decidere. Suggerisce di trattare i dati di streaming come indicatori di gradimento e potenziale radiofonico, non come proxy della forza al televoto. E suggerisce di guardare con molta più attenzione all’identità della nuova direzione artistica, per il 2027, con Stefano De Martino alla conduzione e con possibili innesti dall’industria musicale internazionale, le coordinate estetiche del Festival potrebbero spostarsi verso proposte più esportabili e visivamente impattanti.

È un processo di calibrazione iterativa. Si fa una previsione, si misurano gli errori, si correggono i pesi, si riprova. Non è garanzia di successo, ma è l’unico approccio onesto alla complessità.

Vale per Sanremo. Vale per i vostri dati. Vale per qualsiasi sistema in cui il futuro dipende da variabili umane che nessun dataset ha ancora imparato a misurare davvero.

Le analisi di Gemini citate in questo articolo sono state condotte nel febbraio 2026 durante le serate del Festival di Sanremo. I dati di ascolto, streaming e voto sono quelli ufficiali dell’edizione 2026.