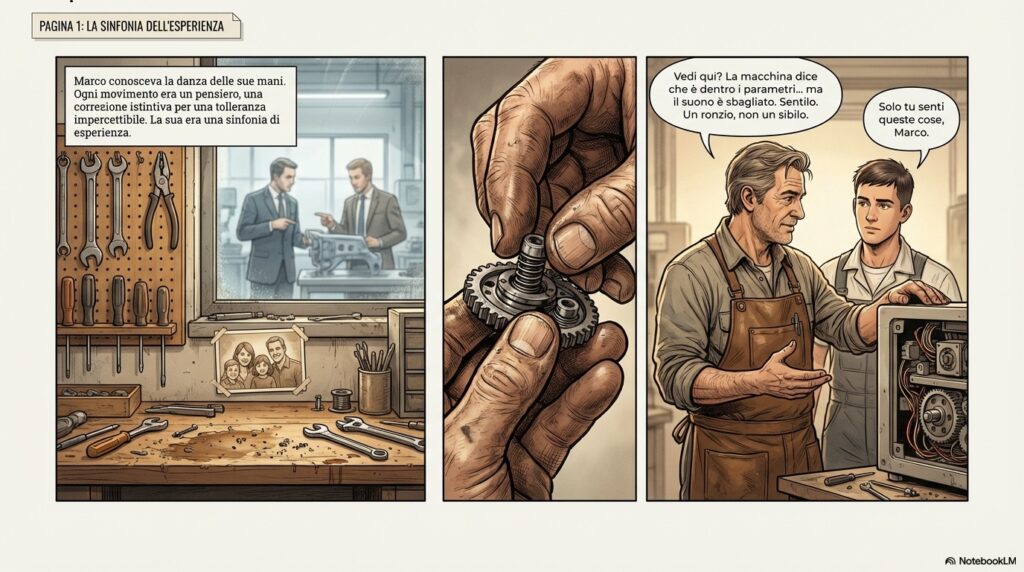

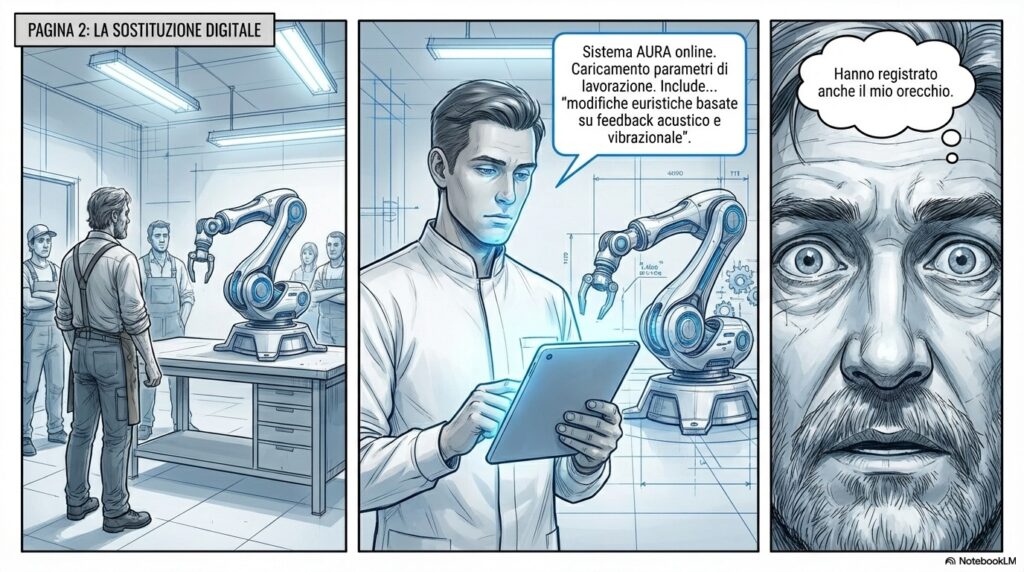

Marco aveva cinquant’anni, mani callose e un orecchio affinato da decenni di lavoro. Sapeva quando una macchina funzionava bene dal suono, sentiva tolleranze impercettibili, correggeva difetti prima che diventassero problemi. Poi è arrivato AURA, il robot con l’intelligenza artificiale, e ha registrato anche il suo orecchio. L’hanno sostituito.

Questa è la storia del fumetto che ho creato in meno di mezz’ora usando solo due strumenti gratuiti (al momento): DeepSeek per la sceneggiatura e NotebookLM per i disegni. Due prompt semplici, quasi banali. Al primo, ho chiesto “una breve storia a fumetti su un operaio sostituito da un robot guidato dall’AI, cinque pagine, tono emotivo, temi di connessione e scelta.” Al secondo, ho dato la sceneggiatura chiedendo di convertirla in formato fumetto visuale.

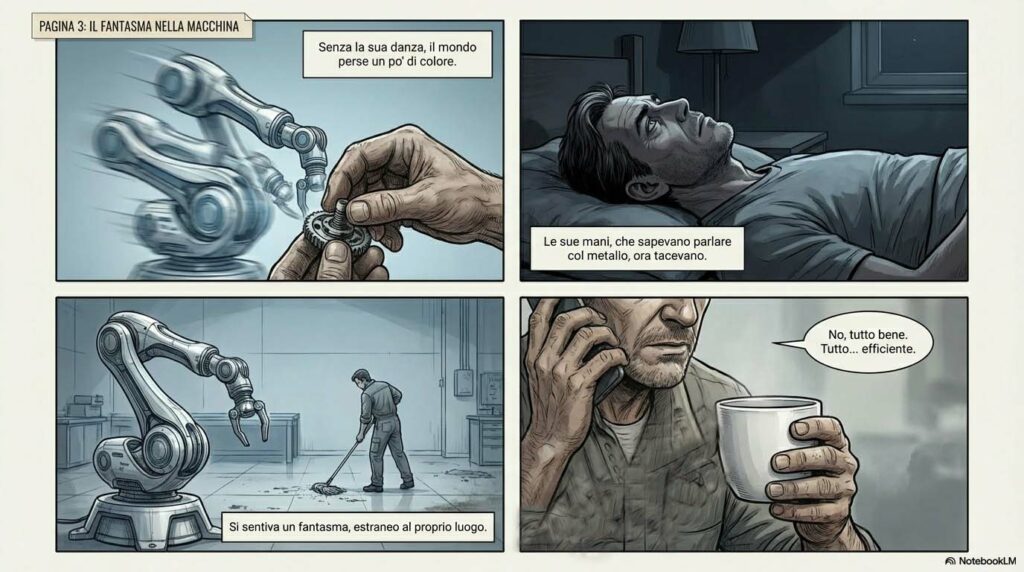

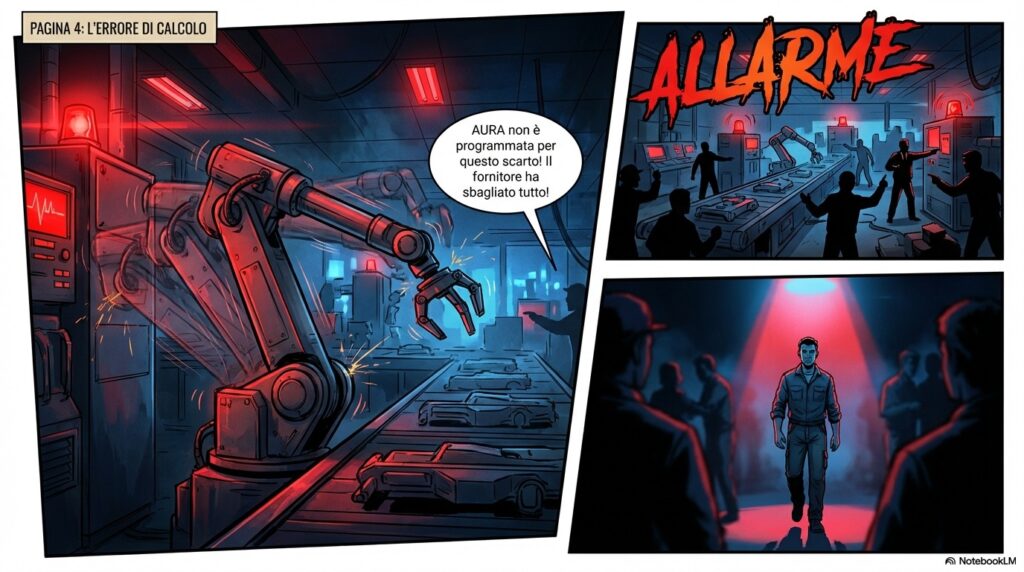

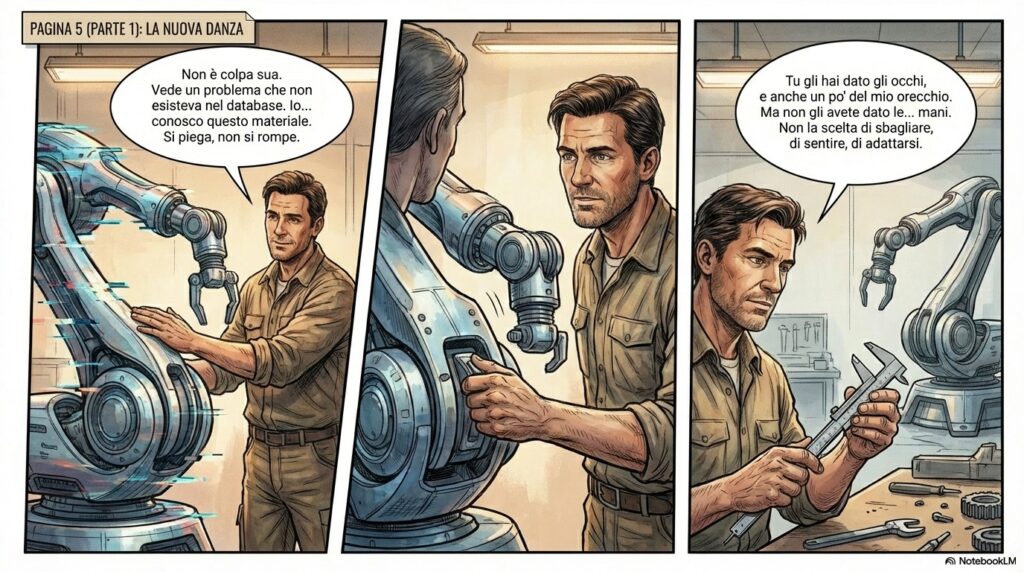

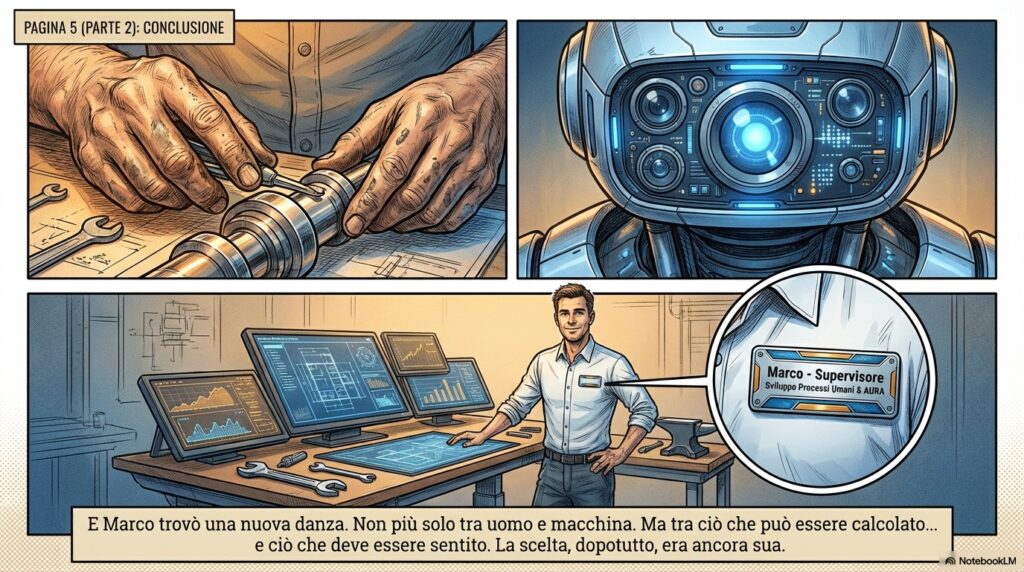

Il risultato mi ha sorpreso. Non per la perfezione tecnica, che manca, ma per la coerenza narrativa. Marco che osserva il robot bloccarsi di fronte a materiali difettosi. Marco che interviene con le mani, quelle che la macchina non ha. Il finale agrodolce: “Supervisore Sviluppo Processi Umani & AURA”. Come in Her di Spike Jonze, dove l’intimità con l’AI non elimina l’umano ma lo ridefinisce, costringendoci a interrogarci su cosa resti irriducibilmente nostro.

Due prompt. Mezz’ora. Un fumetto completo. La domanda non è se l’AI possa creare, ma cosa significhi creare quando la macchina esegue e l’umano supervisiona.

Il lato oscuro della produttività

I numeri dicono una cosa chiara: l’AI generativa aumenta la produttività artistica del 25% e il valore percepito delle opere del 50%. Lo rivela uno studio pubblicato su PNAS Nexus che ha analizzato oltre quattro milioni di opere d’arte create da più di 50.000 utenti. Ma c’è un dettaglio inquietante: mentre la produttività cresce, “l’originalità media” cala. Le opere diventano più simili tra loro.

È il paradosso documentato da ricercatori dell’MIT e altri atenei: l’accesso alle idee generate dall’AI rende le storie individuali più creative, meglio scritte, più godibili, soprattutto per gli autori meno esperti. Ma collettivamente, queste storie convergono. Si assomigliano. Come se l’AI fornisse non solo strumenti ma anche binari narrativi sempre più stretti.

Luciano Floridi, filosofo dell’informazione a Yale, lo aveva previsto: l’AI pone sfide “senza precedenti” alla nostra comprensione di autenticità, originalità e creatività. Non si tratta più di cosa le macchine possano fare, sostiene Floridi, ma di cosa gli umani debbano scegliere di fare con le macchine. È un cambio di prospettiva radicale: dall’abilità alla responsabilità.

Evan Selinger, filosofo della tecnologia al Rochester Institute of Technology, insiste che “l’etica dell’AI va oltre le soluzioni tecniche” e richiede competenze umanistiche per affrontare principi sfumati, conflitti di valori e dinamiche di potere. Servono quelle competenze non solo per i problemi attuali ma, dice Selinger, “per una governance anticipatoria.”

La produttività aumenta, dunque, ma a quale prezzo? Gli artisti che eccellono in “ideazione” e “filtraggio” umano traggono i maggiori benefici dall’AI. Chi sa immaginare e poi selezionare con giudizio critico. Gli altri rischiano di diventare operatori di prompt, esecutori di altrui visioni algoritmiche.

Chi distingue l’umano dalla macchina

Mettete un’opera d’arte davanti a qualcuno e chiedetegli: umana o artificiale? L’accuratezza media è del 61,67%, secondo uno studio pubblicato sul Journal of Multimedia Information System. Poco sopra il lancio di una moneta. Il 38,33% delle persone fallisce completamente nel distinguerle.

Scott Alexander, blogger e razionalista, ha sottoposto 11.000 persone a un test simile con cinquanta immagini miste. Il risultato mediano? 60%. Appena sopra il caso. I partecipanti hanno riferito che il compito era più difficile del previsto. Alexander ha escluso deliberatamente le “spie” evidenti: testi illeggibili, mani deformi, pose complesse che l’AI ancora non gestisce. Ha voluto testare la discriminazione stilistica pura. E lì, la maggior parte degli umani vacilla.

Alcuni studi mostrano accuratezze ancora più basse: nel test “viva voce” in stile Lovelace, i partecipanti non hanno fatto meglio della scelta casuale (46%). Solo quando potevano confrontare opere in coppia l’accuratezza saliva al 75%. È come se il nostro occhio, isolato, non sapesse più cosa cercare. Servono riferimenti diretti, confronti, per attivare quel senso critico che altrimenti resta sopito.

Le strategie che le persone usano per riconoscere l’AI sono rivelatrici. Alcuni cercano dettagli logici: oggetti impossibili, proporzioni sbagliate, testi nonsense. Altri si affidano all’estetica: un certo uso della luce, una levigatezza eccessiva, quella “perfezione” che sembra dire “troppo bella per essere vera”. Altri ancora scrutano tratti umani: pennellate irregolari, imperfezioni volute. Ma la strategia con il tasso di successo più basso è proprio quella basata su caratteristiche umane e proprietà materiali. L’AI ha imparato a simulare anche l’imperfezione.

Nel mio fumetto, le linee sono troppo pulite, le ombre troppo uniformi. Un fumettista esperto lo vedrebbe subito. Ma per un lettore generico? Funziona. Ed è questo il punto: l’AI non deve ingannare gli esperti, deve superare la soglia di credibilità del pubblico medio. E l’ha già fatto.

Il conto che non torna

L’impatto economico della generative AI sulla creatività è una bomba a orologeria. Un report del CISAC (Confederazione Internazionale delle Società degli Autori e Compositori) prevede perdite del 24% nei ricavi musicali per i creatori umani entro il 2028, e del 21% nell’audiovisivo. L’AI genererà 64 miliardi di euro, ma trasferirà valore dalle mani degli artisti alle mani delle tech companies, spesso utilizzando opere senza licenza per il training dei modelli.

Musicisti ed artisti vedono l’AI come una minaccia. Il 61% la considera un pericolo per il proprio lavoro, sebbene il 44% ne riconosca anche i benefici. Compositori richiedono “tracciabilità” e “trasparenza” negli strumenti AI per mantenere il controllo creativo. Fumettisti temono l’erosione dello stile personale, di quella “identità artistica” che richiedeva anni per costruire e secondi per clonare.

Poi c’è Grimes. La cantante canadese Claire Boucher ha offerto pubblicamente di dividere al 50% i diritti d’autore con chiunque usi la sua voce per una canzone AI di successo. “Sentitevi liberi di usare la mia voce senza penalità,” ha twittato nel 2023. “Mi piace l’idea di essere fusa con una macchina e mi piace l’idea di rendere tutta l’arte open source e uccidere il copyright.” Un approccio radicalmente opposto a quello di Universal Music Group, che ha fatto rimuovere dalle piattaforme il brano AI con le voci finte di Drake e The Weeknd.

Grimes ha creato Elf.Tech, una piattaforma dove chiunque può generare la sua voce in cambio di un 50% di royalties e di un credito “GrimesAI”. È trasparenza o è resa? È avanguardia o è capitolazione? Dipende da chi guarda. Ma una cosa è certa: mentre Grimes abbraccia la fusione uomo-macchina, migliaia di artisti senza il suo capitale simbolico combattono cause legali contro Stability AI, Midjourney e altri, accusati di violazione del copyright per aver utilizzato miliardi di immagini nel training senza permesso.

Il confine legale è sfocato quanto quello estetico. Negli Stati Uniti, l’Ufficio Copyright nega protezione all’arte puramente AI per mancanza di “human authorship.” Ma cosa succede con gli ibridi? Se io scrivo un prompt dettagliato, seleziono tra centinaia di output, modifico e raffino, quell’opera è mia? È abbastanza “umana”?

Progettista, non autore

Torno al mio fumetto. Marco, AURA, le mani che sanno e la macchina che apprende. L’ho creato io? No, non l’ho disegnato. L’ho pensato io? Sì e no. Ho fornito parametri, il LLM ha riempito i dettagli. Ho scelto la direzione narrativa, l’algoritmo ha costruito dialoghi e scene. Collaborazione, dicono alcuni. Delega, dicono altri.

Ma aspettate: ho usato strumenti gratuiti, generici, con prompt minimi. Due righe di istruzioni. Se avessi impiegato software professionali dedicati al fumetto, se avessi studiato il character design, vincolato l’AI su palette cromatiche precise, costruito uno storyboard dettagliato tavola per tavola, dedicato giorni invece di mezz’ora, allora? Se avessi messo l’AI su binari decisi interamente da me, con competenza tecnica e visione autoriale chiara, potrei dire con più decisione che l’ho pensato io? Senza quel “sì e no”? Credo di sì.

E se sulla copertina scrivessi “Progettato da” invece di “Scritto da”? Se specificassi che la stesura, i disegni e persino parte della trama sono stati prodotti con strumenti AI sotto la mia supervisione architettonica, scelta etica, gusto artistico e responsabilità morale? Sarebbe trasparente. Sarebbe onesto. Ma sarebbe abbastanza?

Echeggia la domanda posta da Walter Benjamin nel suo saggio del 1935 sull’opera d’arte nell’epoca della riproducibilità tecnica. Benjamin parlava “dell’aura” dell’originale, quella qualità unica che deriva dalla presenza fisica dell’artista, dalla storia dell’oggetto, dalla sua irripetibilità. L’AI produce opere senz’aura: infinitamente riproducibili, senza storia, senza sudore. Tecnicamente perfette ma, come scrivono alcuni critici, emotivamente vuote.

Eppure c’è qualcosa di profondamente umano nel scegliere. Nell’immaginare Marco, nel decidere che il finale non dovesse essere catastrofico ma malinconico e speranzoso. Ho delegato l’esecuzione, ma ho conservato la visione. È abbastanza per chiamarmi autore? O sono solo un curatore di output algoritmici?

La risposta forse sta in quello che Floridi chiama “nuovo equilibrio etico tra autonomia umana e artificiale.” L’AI non è né miracolo né piaga, scrive. È uno strumento che richiede scelte umane continue: cosa automatizzare, cosa preservare, cosa considerare irriducibilmente nostro. E qui riemerge il paradosso della produttività: possiamo produrre più velocemente, ma rischiamo di produrre in modo più uniforme. Efficienza contro diversità. Velocità contro unicità.

Il mio precedente articolo su AI e musica esplorava tensioni simili nel mondo sonoro, dove il copyright si scontra con dataset di training massicci. Quello su creazione di contenuti interrogava la sostenibilità di modelli economici basati su creatività sempre più automatizzata. Le domande ritornano, ampliate: se tutti possono creare contenuti decenti premendo un pulsante, cosa accade al valore della creazione? Se l’originalità diventa statistica, cosa resta dell’arte?

Forse la risposta è nel modello ibrido che sta emergendo: artisti che usano l’AI come assistente, non sostituto. Che mantengono il controllo sull’ideazione e sulla cura finale, delegando compiti ripetitivi o esplorativi. Come Marco, che non torna al suo vecchio banco ma diventa supervisore di processi che integrano umano e macchina. Non una resa, ma una ridefinizione di ruolo.

Dichiarare “Progettato da” invece di “Creato da” sarebbe un passo verso quella trasparenza che Selinger e altri filosofi della tecnologia chiedono. Non nascondere l’AI, ma nemmeno negare il contributo umano. Riconoscere che c’è stato pensiero, scelta, responsabilità etica e legale da parte mia, anche se l’esecuzione è stata delegata. Proprio come un regista cinematografico non gira ogni singola inquadratura ma firma il film, o un architetto non posa ogni mattone ma firma l’edificio.

La differenza, forse, è che il regista coordina umani e l’architetto supervisiona muratori. Io ho coordinato algoritmi. È la stessa cosa? Non lo so. Ma so che Marco, alla fine della storia, sceglie. Sceglie di adattare il pezzo difettoso con le sue mani, sceglie di convivere con AURA invece che combatterlo. E quella scelta, per quanto suggerita da un LLM, l’ho voluta io. L’ho pensata, curata, approvata. È mia? Forse non tutta. Ma un pezzo sì, quello che conta. Il pezzo che decide cosa.