Sui Peanuts sono stati scritti trattati di fisica, sociologia, filosofia, psicoeconomia e naturalmente psicologia. In particolare Lucille “Lucy” van Pelt è stata oggetto di studi ‘seri’ per il suo carattere; definita dal suo creatore Schultz come una bambina “ostinata” e “dominatrice”, che ama mettere alla prova gli altri, la vediamo spesso rimproverare e disilludere chi le sta intorno, con la sola eccezione del suo amato Schroeder a cui si rivolge con monologhi sempre finalizzati a esaltare se stessa.

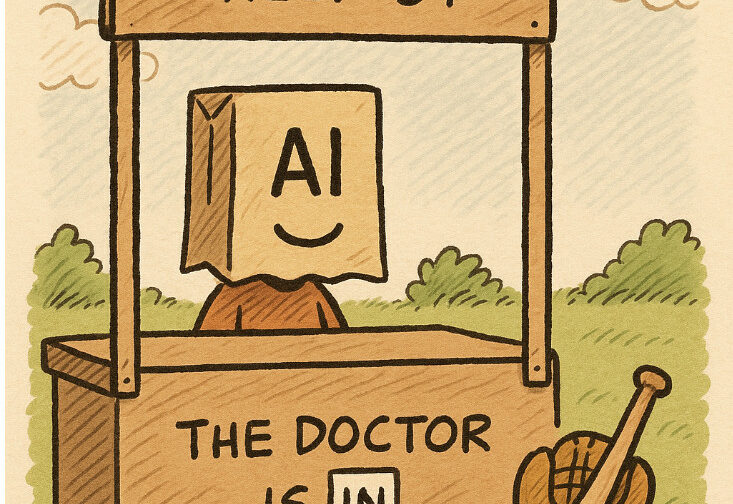

Con l’umorismo malinconico e riflessivo che contraddistingue le strisce di Snoopy e i suoi amici, sembra del tutto logico che una persona con quelle caratteristiche possa esercitare la professione di psichiatra elargendo consigli cinici e demotivanti per soli 5 centesimi. È anche palese che il suo più affezionato paziente sia Charlie Brown che, dopo ogni seduta, esce peggio di quando è entrato.

Comunque la pensiate sul supporto psicologico bisogna riconoscere che sempre di più persone cercano qualcuno che le ascolti. Non sto qui a dilungarmi sul perché o sui percome: mi piacciono i computer perché puoi spegnerli quando decidi tu, con esseri a base di carbonio non ci riesce a meno che non si investano decine di euro in alcol.

Sarebbe bello se i computer potessero ascoltarti e risponderti, ma, un momento!, siamo nel 2025, già lo fanno

L’intelligenza artificiale è quasi sempre al centro di conversazioni sulle capacità logiche, di QI, ma molto meno del “quoziente emotivo” delle AI. Eppure, le interazioni emotive con assistenti digitali sono sempre più frequenti: molte persone si rivolgono ai chatbot non solo per scrivere testi o risolvere problemi tecnici, ma anche per chiedere consigli, compagnia o persino conforto psicologico.

| Topic principale di utilizzo | Percentuale stimata |

| 🔍 Ricerca informazioni / Q&A | ~35% |

| 💼 Produttività (scrittura email, riassunti) | ~25% |

| 📚 Studio, spiegazioni, tutoraggio | ~15% |

| 🎨 Creatività (storie, poesie, arte) | ~10% |

| 🧘 Supporto emotivo / “auto-terapia” | ~3% |

| 💻 Coding & debug | ~5% |

| 🤝 Roleplay / compagnia simulata | ~1% |

| 🎲 Giochi, curiosità, chiacchiere leggere | ~6% |

Questi dati non sommano a 100% perché spesso in un’unica sessione gli utenti fanno più cose.

Sono aggregati dai log di utilizzo anonimi e da survey (OpenAI, Anthropic, dati Stanford + HAI 2024).

- Ad esempio molti mettono nella stessa sessione “mi aiuti a scrivere questa email + spiegami questo concetto + fammi anche una battuta”.

- Il supporto psicologico / auto-aiuto resta una nicchia (2-3%), ma è in crescita specie nei giovani.

Nel recente articolo “How People Use Claude for Support, Advice, and Companionship” pubblicato da Anthropic, l’azienda che sviluppa Claude.ai, è stata fatta una disamina sulle conversazioni tenute con l’ai, uno scenario parziale ma non per questo meno interessante.

L’analisi ha preso in esame oltre 4,5 milioni di conversazioni, selezionando quelle con un chiaro contenuto “affettivo”: dialoghi personali, richieste di coaching, consulenza, consigli su relazioni, o bisogno di compagnia. Il risultato? Solo il 2,9% delle interazioni rientra in questa categoria, un dato in linea con ricerche analoghe su ChatGPT. La percentuale di conversazioni legate a romanticismo o roleplay sessuale è ancora più bassa: meno dello 0,1%.

Le persone si rivolgono a Claude soprattutto per affrontare momenti di transizione, come cambi di lavoro, crisi relazionali, periodi di solitudine o riflessioni esistenziali. Alcuni utenti sono anche professionisti della salute mentale che usano l’AI per redigere documentazione clinica o gestire compiti amministrativi. In alcuni casi, conversazioni iniziate per motivi pratici si trasformano in veri e propri dialoghi di ‘compagnia’, specie quando si protraggono nel tempo.

Un dato interessante è che, nella maggior parte dei casi, Claude non “schiva” le richieste emotive degli utenti: meno del 10% delle conversazioni “affettive” vede il modello rifiutarsi di rispondere. Tuttavia, quando lo fa, è per tutelare l’utente: ad esempio, si rifiuta di dare consigli pericolosi sulla perdita di peso o di assecondare pensieri autolesionistici, indirizzando piuttosto verso fonti professionali.

Un altro aspetto emerso è che il tono emotivo degli utenti tende a migliorare nel corso del dialogo. Pur non potendo valutare gli effetti psicologici a lungo termine, i ricercatori hanno rilevato un cambiamento linguistico verso sentimenti più positivi alla fine della conversazione, suggerendo che Claude non amplifica emozioni negative.

In un vecchio film di Marco Ferreri un Lambert in splendida forma, dopo aver detto basta con le ragazze in carne ed ossa, si innamora di un piccolo oggetto, un portachiavi elettronico, che risponde al suo fischio con le parole “I love you”.

Quindi se non è proprio positivo, ha un effetto neutro almeno finché la conversazione rimane attiva.

Chiaro che siamo solo agli inizi e che mi aspetto casi eclatanti con titoli cubitali sgrammaticati ad hoc per enfatizzare l’aspetto negativo di tutto ciò.

Per prevedere veramente il futuro, come al solito, occorre rivolgersi agli artisti.

Film e libri su come l’AI possa entrare nella nostra testa e farne un uso arbitrario alimentano un catalogo molto ben nutrito. Ma da “metropolis” e “il pianeta proibito” fino a “her” e “transcendence”, quasi mai finisce bene.

Forse l’esempio più preoccupante lo troviamo in blade runner 2049 dove il rapporto tra il replicante k e l’intelligenza artificiale interpretata da Ana de Armas assume toni tra il grottesco e l’incubo condiviso quando coinvolgono nel loro rapporto una terza persona, una prostituta piuttosto malmessa, usata per dare ‘fisicità’ alla Armas, sfida impossibile.Uno scenario nemmeno tanto lontano se si pensa che il prossimo step sarà dare un corpo da androide all’AI.

Viste tutte le premesse è chiaro che il ragazzo dalla grande testa tonda commetta il più classico degli errori a servirsi di un supporto che fin dallo scalcinato banchetto e dalle insegne arrangiate, dimostra tutta la sua scarsa affidabilità. Ci chiediamo perché continua a farlo, forse perché gli basta essere ascoltato anche se sa benissimo che quando si tratta di calciare un pallone è meglio avere come compagno il silenzioso ma fedele Linus piuttosto che qualcuno che parla costantemente di tutto senza saperne molto e che, appena vi vede pronto a calciare con tutta la forza che avete, vi toglie il pallone facendovi ruzzolare a testa in giù…